iOS 15: Live Text nutzen und Text mit Spotlight in Fotos finden

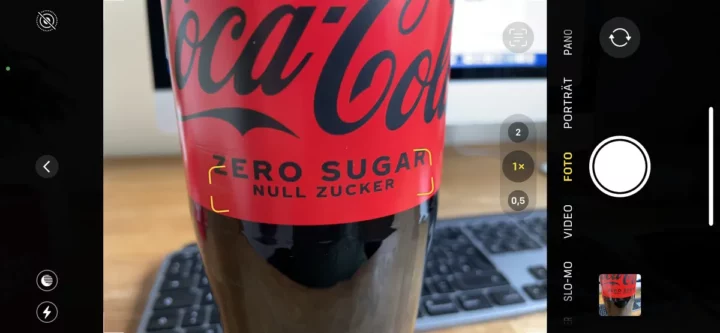

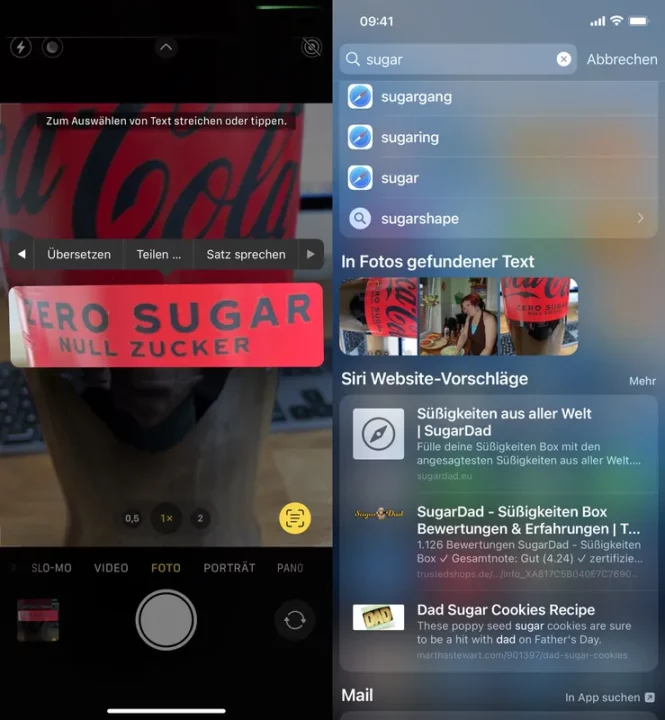

Ihr habt es natürlich mitbekommen, iOS 15 ist erschienen und kann auf unterstützte iPhones geladen werden. Zahlreiche der neuen Funktionen haben wir hier schon für euch beschrieben, manches kann man sich aber auch noch einmal in Erinnerung rufen. Beispielsweise die Funktion Live Text und das Auffinden von Text in Fotos direkt über die Spotlight-Suche. Live Text begegnet euch, wenn ihr mit der Kamera-App auf etwas zeigt, das erkennbaren Text bietet. Live Text erkennt viele hilfreiche Informationen in Bildern. So können Nutzer bei erkannter Telefonnummer einen Anruf machen, eine E?Mail senden oder eine Wegbeschreibung aufrufen, einfach, indem man auf den hervorgehobenen Text in einem Foto tippt. Auch das Kopieren und Weiterleiten ist ganz einfach möglich. Das Extrahieren des Textes funktioniert über das Textsymbol rechts oben (siehe unser Screenshot oben).

Das kann auch zu Übersetzungszwecken genutzt werden. Live Text versteht sieben verschiedene Sprachen: Englisch, Chinesisch, Französisch, Italienisch, Deutsch, Portugiesisch und Spanisch. Und durch die systemweite Übersetzung kann man einfach tippen und übersetzen (linker Teil des Screenshots über diesem Absatz. Zu guter Letzt findet die Spotlight-Suche auch Text in Bildern. Der Index scheint flott zu arbeiten – und bereits existente, lokale Bilder werden auch verarbeitet. Nützlich!

iPhone mit iOS 15: Adressleiste oben anzeigen

Safari für iOS: Tabs suchen und selektiv löschen

Tipp für iOS und iPadOS: Mehrere geöffnete Safari-Tabs gleichzeitig im Lesezeichen-Ordner sichern

Tipp für Safari unter iOS und iPadOS: Zuletzt geschlossene Tabs anzeigen

iPadOS 15: Safari lässt euch die Qual der Tableisten-Wahl

Safari: Übersetzt jetzt auch am Desktop Webseiten

iOS 13: Safari schließt Tabs auf Wunsch automatisch

Safari-Erweiterung Keyword Search nun auch für iOS 15 und iPadOS 15

Transparenz: In diesem Artikel sind Partnerlinks enthalten. Durch einen Klick darauf gelangt ihr direkt zum Anbieter. Solltet ihr euch dort für einen Kauf entscheiden, erhalten wir eine kleine Provision. Für euch ändert sich am Preis nichts. Partnerlinks haben keinerlei Einfluss auf unsere Berichterstattung.

Ziemlich beeindruckend, als ich gestern Abend meine Fernbedienung fotografierte und dann den Markennamen kopieren konnte, als wäre es Text. Freue mich darüber vor allem, wenn ich an endlose Verwendungszwecke auf Papierrechnungen denke, die kein Mensch abtippen will, aber hin und wieder muss.

Ab welchem iPhone funktioniert dies denn? Mein iPhone X kann es nicht, dass XR schon. Die Info wäre ganz gut.

Ab Xs …und wie du sagst dann wohl auch das Xr.

Wenn Du ein älteres iPhone hast, aber eine vergleichbare Funktion suchst, schau Dir mal Scan2Clipboard an. Macht im Prinzip das Gleiche, auch wenn LiveText es etwas schöner umgesetzt hat.

Eine wirklich tolle Funktion. Ein I-Tüpfelchen fehlt aber: In der globalen Spotlight-Suche findet Siri zwar Carstens Cola-Flasche, aber in der Fotos-App funktioniert das in der Suche noch nicht mit direkten Texten.

Und was kann das jetzt mehr als das was Google Lens seit Jahren beherrscht?

War auch mein Gedanke. Vermutlich weil es von Apple kommt.

Es ist ziemlich identisch zu Google Lens, man musste als iPhone Nutzer aber bisher halt immer eine App dafür benutzen und es macht halt einen großen Unterschied für die Nutzung ob etwas nativ integriert ist.

Hat wer gesagt, dass Google es nicht besser oder ebenso gut macht? Wenn du im Apple Ökosystem bist, ist das aber neu und flasht uns jetzt so, wie dich damals bei deinem Google Handy.

Seit „Jahren“? Soweit ich das verfolgt habe, kam die on-device- / Offlinefunktionalität bei Lens aber auch erst im Februar 2021, also vor sieben Monaten.

Und ob / wie Lens im Standardzustand arbeitet, weiß ich gerade nicht. Aber ich hätte meine Probleme damit, Google nicht nur Bilder / Fotos zu übermitteln UND dann auch noch deren Server sämtliche Textinhalte auslesen (und speichern) zu lassen.

Schnell mal die Krankmeldung für die Krankenkassen-App fotografieren und schon weiß Google, dass du gerade den Befund X, Y oder Z hast, und zwei Tage später bekommste dann Werbung für Pilzcreme, Stimmungsaufheller oder Babyartikel…

Weiß jemand warum das unter iPadOS nicht geht? Man kann dort nicht direkt aus der Kamera Text auswählen, aber ein Foto machen und dann direkt den Text auswählen

Tolle Funktion und sehr intuitiv integriert. Muss öfter mal einen WLAN Code von einem Router abfotografieren und da ist das extrem nützlich.