Raspberry Pi: Neue AI-Kamera und ein Monitor kommen

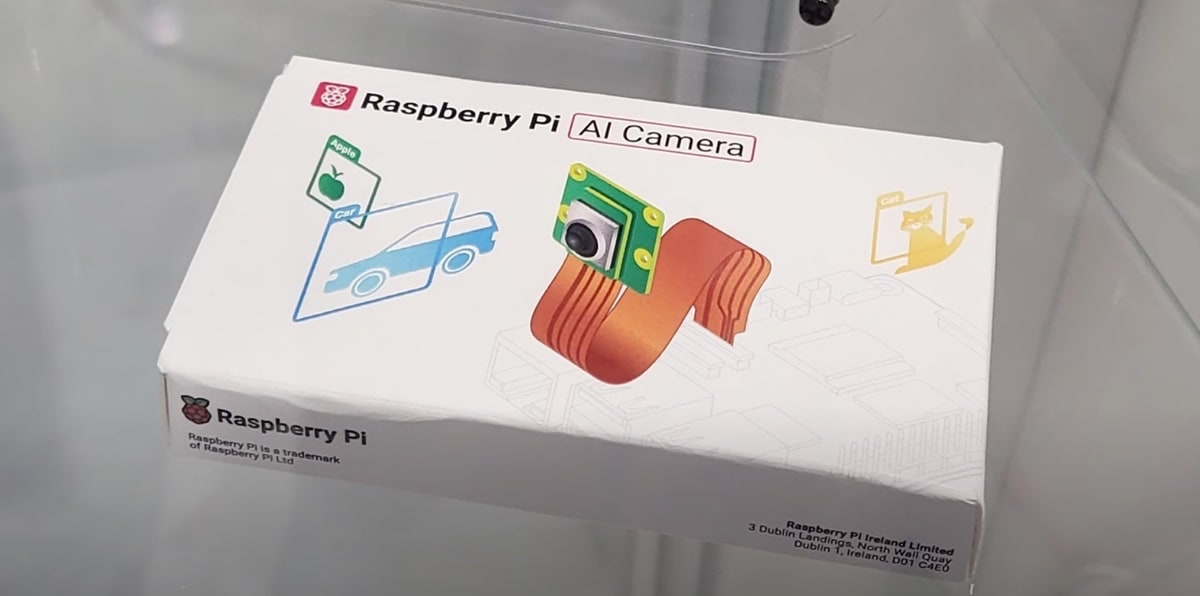

Tam Hanna war auf der Embedded World 2024 unterwegs und hat mich heute Morgen auf sein Video hingewiesen. Auf der Messe gab es bisher Unangekündigtes von Raspberry zu sehen. So zeigt das Unternehmen seine neue AI Camera mit einem Raspberry Pi Zero 2 W und einem Sony IMX500 AI-Sensor. Im Video sieht man das Kit, das Objekterkennung und Körpersegmentierung in Aktion zeigt. Preise und Verfügbarkeitsinfos gibt es bislang keine.

Ebenso wird das Unternehmen wohl einen portablen Monitor anbieten, der 15,6 Zoll bieten wird. Er löst mit 1920 x 1080 Pixeln auf und verfügt ebenfalls über integrierte Lautsprecher.

Auch hier gibt es keinen Preis – wobei man festhalten muss, dass diese (portablen) Monitore immer günstiger werden und der Markt somit als schwierig zu bewerten ist.

Transparenz: In diesem Artikel sind Partnerlinks enthalten. Durch einen Klick darauf gelangt ihr direkt zum Anbieter. Solltet ihr euch dort für einen Kauf entscheiden, erhalten wir eine kleine Provision. Für euch ändert sich am Preis nichts. Partnerlinks haben keinerlei Einfluss auf unsere Berichterstattung.

Was ist daran jetzt „AI“? Eine Objekterkennung gab es bei Picasa schon vor über zehn Jahren auch ohne Internetanschluss, das selbe mit der Gesichtserkennung bei Kameras! Mit „AI“ fängt man Mäuse.

AI ist das neue Krypto! Da wird eine Sau nach der anderen durchs IT-Dorf getrieben, gefühlt in immer kürzeren Zeitabständen.

Der Unterschied ist die Technik dahinter. Die Gesichtserkennung in der Digitalkamera für den Fokus ist Handprogrammiert. Mit viel Hirnschmalz optimiert, damit es auf der lahmen Hardware funktioniert und auf einen ganz speziellen Zweck getrimmt – für nichts anderes zu gebrauchen.

Bei KI-Gesichtserkennung hat man einmal ganz allgemeine Dinge von Hand programmiert, dann einen Stapel Bilder mit Gesichtern und einen Stapel Bilder ohne Gesichter da rein gefüttert und das heraus gekommene Modell kann Gesichter erkennen. Hätte man Bilder von Katzen und ohne Katzen rein gefüttert, wäre ein Modell raus gekommen, das Katzen erkennt, aber keine Gesichter.

Und genau hier wird es spannend: Der KI-Kamera kann man eigene Modelle (oder heruntergeladene) verpassen, jenachdem, was sie können soll. Ich überlege sowas über das Katzenklo zu bauen und eine Waage darunter – dann könnte ich alle drei Tiger „im Auge“ behalten was ihre Ausscheidungen betrifft und so manches Gesundheitsproblem erkennen, bevor es anderweitig sichtbar wird.

Dafür bräuchte ich dann ein KI-Modell, dass meine drei Katzen auseinander halten kann und den unterschied zwischen Wurst und Pipi-Klumpen erkennt. Trainingsmaterial ließe sich schnell sammeln… 🙂

Och, nicht schon wieder eine Kamera mit Flachbandkabel. Hätte man nicht endlich mal ein Rundkabel nehmen können, um eine flexiblere Installation zu ermöglichen?

Kann die mir dann auch sagen welche Vögel bei uns zur Futterstelle kommen, oder kann die dann nur sagen: Vogel!

Wäre witzig eine Statistik zu haben welche Art wann und wie häufig zum futtern erscheint. Dass die dann nicht zwischen Induviduen einer Art unterscheiden kann ist klar.

Das ist kein Problem wenn Du ein geeignetes AI Modell anlernst. In der Firma haben wir sowas mit bestimmten Dokumenten gemacht dessen Daten wir weiterverarbeiten. Das manuelle abtippen der Daten war zu Fehleranfällig. Derzeit hat die AI 98% Genauigkeit. Tendenz steigend da alle nicht erkannten Dokumente angelernt werden. Das von uns verwendete AI Modell erkennt auch wenn es die Dokumente nicht erkennen kann und steuert die an Menschen aus. Bei uns übernimmt die AI auch schon länger einfache Aufgaben wie Vertragskündigungen. Du musst also nur Vögel anlernen was vermutlich deutlich schwieriger ist da die frecherweise nicht immer die gleiche Position im Bild einnehmen. Deshalb ist es auch so leicht Schriftstücke und Mails weiterzuverarbeiten. Nur bei handschriftlich erstellten Schreiben stößt die OCR Engine an ihre Grenzen.

falls es auch über Akustik o.k. wäre kannst Du das hier versuchen: https://www.raspberrypi.com/news/classify-birds-acoustically-with-birdnet-pi/

Wenn du kein fertiges Modell findest, müsstest du selbst eines trainieren. Ist gar nicht so schwierig, man muss nur erstmal das Trainingsmaterial haben. Also eine Zeitlang müsstest du manuell die Vögel erkennen und die Bilder sortiert ablegen. So ab ca 20 Bilder pro Art kannst du versuchen, diese Art deiner KI beizubringen, jenachdem wie gut die Bildqualität ist.