Google Lookout soll blinden und sehbehinderten Menschen im Alltag helfen

Künstliche Intelligenz ist allgegenwärtig, auch wenn sich meist wenig Intelligenz und „nur“ Algorithmen dahinter verbergen. Egal welche Technologie im Einsatz ist, man kann daraus einen echten Mehrwert ziehen, vor allem Menschen mit Behinderungen. Google hat sich für Blinde und sehbehinderte Menschen etwas ausgedacht – Lookout heißt die neue Android-App, die bereits im Mai letzten Jahres angekündigt wurde.

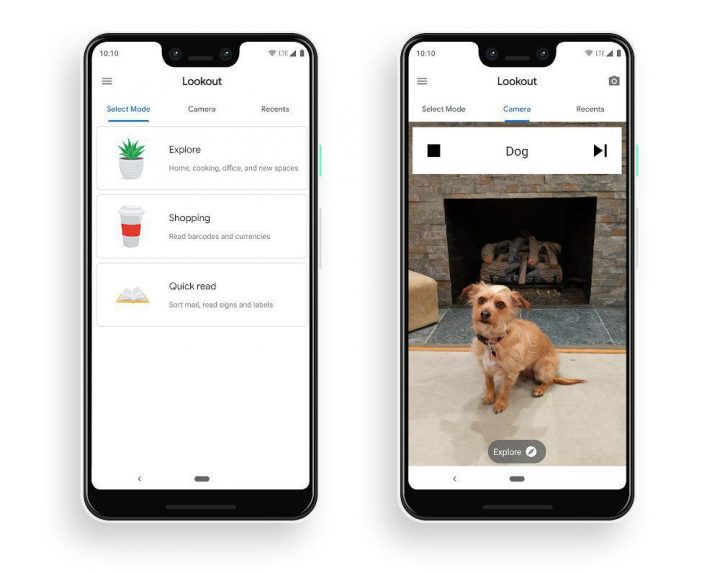

Lookout nutzt dieselbe Technologie, die auch Google Lens für die Objekterkennung einsetzt. Der Anwender hat die Möglichkeit, aus drei verschiedenen Modi zu wählen. Mit Explore soll man sich in neuen Umgebungen besser zurechtfinden können, Shopping lässt euch Barcodes und Währungen scannen und Quick Read hilft beim Vorlesen von Dokumenten und kurzen Texten etc.

Google empfiehlt, das Smartphone mit der Kamera nach vorn gerichtet um den Hals zu hängen. Das Gerät erklärt euch dann, was um euch herum vorgeht.

Lookout ist aktuell nur für Pixel Smartphones und in Englisch verfügbar, weitere Sprachen und Geräte sind wohl in Planung. iOS-Nutzer können beispielsweise auf „Seeing AI“ von Microsoft zurückgreifen.

https://play.google.com/store/apps/details?id=com.google.android.apps.accessibility.reveal

Lookout – Computer Vision Assistive App für Menschen mit Sehbehinderung

Lookout uses computer vision to assist people who are blind or have low vision in gaining information about the world around them.

Lookout uses the camera and sensors on your device to recognize objects and text, and gives you spoken feedback, earcons, and other signals to inform you about what it sees.

Lookout is available for Pixel 1, Pixel 2, and Pixel 3 devices running Android 8.0 and above.

Learn more about Lookout in the Help Center:

https://support.google.com/accessibility/android/answer/9031274

Ähnliche Apps gibt es mit „SeeingAI“ oder „EnVision“ schon für iOS. Ebenfalls eine Lösung über eine an einer Brille befestigte Kamera namens „orcam“, letztere sogar standalone ohne Smartphone nutzbar . Dennoch gut daß sich hier immer mehr tut – das ist hoffentlich erst der Anfang . Interessant it auch ein Proddukt welches es m. W. bislang nur in den USA und evtl. auch in Australien gibt. Hier können sich blinde entweder über eine Kamerabrille oder die Kamera des Smartphones mit einem Dienstleister verbinden der ihnen on-the-go Assistenz bietet , angefangen vom Vorloesen von Dokumenten bis hin zur Wegweiisung in fremder Umgebung. Der dienst ist natürlich kostenpflichtig , ähnlich wie ein Streaming-Angebot , und erfordert eine ständige Online-Verbindung mit genügen Bandbreite für gut aufgelöstes Echtzeit-Video. Also in DL wohl noch Zukunftsmusik , gerade wenn man ausserhalb von Ballungszentren unterwegs ist. Ich selber nutze EnVision und SeeinAI hier sowohl für das Erkennen von Texten wie auch als Lichtdetektor (habe ich meine Lampen aus? Ist ein Gerät an oder aus ?) und habe mit einem Programm dieser Art sogar schon – leider erfolglos – versucht auf einem Android-handy die Sprachausgabe ohne sehende Hilfe selber einzurichten . Das geht so richtig smooth eben im Moment wohl leider immer noch nur unter iOS….

sehr schön, schade das ich es nicht testen kann, habe kein solches smartphone. Da ich blind bin baue ich ausschliesslich auf Apple Produkte mit voiceover als screen-reader. Auf meinem iPhone habe ich mehrere solcher hilfreichen apps für Blinde, auch Seeing AI. Es gibt da eine Menge von guten apps die uns die Orientierung erleichtern, uns Gegenstände erkennen lassen, Lichtquellen, Personen, Geldscheine, Produkte im Supermarkt, beliebige Texte use.

Wenn Interesse besteht kann ich gerne mal einen podcast dazu machen oder einen Artikel verfassen.

Rein interessehalber: Benutzt Du auch auch „Be My Eyes”, wo man sich einen sehenden als Hilfe zuholen kann? Am Anfang bekam ich noch einiges an Anfragen (bin als Sehender registriert), aber dann gab es immer öfter ein „ein anderer hat schon geanwortet“ und jetzt kommt kaum noch was.

Servus Ralf, ich möchte mir inKürze ein IPhone zulegen, weiß nur noch nicht welches. Ich sehe nur noch 2 Prozent und würde mich über einen Bericht freuen.Du müsstest dann nur noch sagen wo man diesen Bericht dann finden kann.

Gruß Jürgen

Hallo Ralf , das Problem bei Android ist eben, daß es nicht das eine Android gibt das so ist wie alle. Von Smartphone zu smartphone kann es da Unterschiede geben – ich hatte es mit einem zugegeben Billig-Nokia mit angeblich Stock-Android versucht, bekam den Screenreader TalkBak auch eingeschaltet – es waren auf dem Gerät aber keine deutschen Stimmen vorinstalliert , sobald ich auf „deutsch“ als Systemsprache wechselte , war TalkBack noch da (dass konnte ich eben über die Texterkennung mit dem iOS-Gerät auf dem Android-Bildschrirm nachvollziehen), aber es kam kein Ton mehr heraus. Eine Komplettinstallation einer deutschen TTS war mir mit dieser extremen „Hilfskonstruktion “ der Texerkennung auf einem Smartphone-Bildschirm mit Hilfe eines anderen Smartphones nicht möglich bzw. auch zu mühsam und keineswegs „alltagstauglich“ und ich schickte das Produkt zurück. Sowas muß ähnlich „out of the Box“ ggf . über einen einfachen Hotkey wie bei iOS und einigen Android-Versionen – m. W. geht das auf den Pixel-Geräten wirklich gut – funktionieren. Hier stehen wir ähnlich da wie unter Linux oder manchmal auch unter windows : Was auf einer Kiste gut läuft mit Screenreader , kann unter einer anderen Konfiguration nicht oder nur eingeschränkt laufen. Da ist ein geschlossenes System wie bei Apple, wo hardware , Betriebssystem _und_ Screenreader aus einer hand kommen wesentlich betriebssicherer .

Hallo,

Hat jemand Erfahrung, ob es auch mit pixel Experience geht, wollte mir evtl. diese custom Rom auf meinem S2 installieren.