Google AutoFlip: Offene Plattform für automatisches Video-Reframing

Google hat mit AutoFlip eine neue Open-Source-Lösung vorgestellt, welche beim automatischen Reframing von Videos helfen soll. Eine derartige Lösung sei mittlerweile äußerst nützlich, da das Gros der Inhalte zwar in 16:9 oder aber 4:3 produziert werde, aktuelle mobile Endgeräte aber mittlerweile andere Formate nutzen – wie z. B. 19,5:9.

Ihr kennt das: Ihr habt dann am Smartphone die Wahl das Bild unverändert in 16:9 anzuzeigen, sodass ein Teil eures Displays eben ungenutzt bleibt, oder aber den Screen auszufüllen und mit Cropping / Stretching zu leben. Das Reframing ist dabei an sich eine heikle Sache: Denn verändert man das Bildformat, können wichtige Informationen herausfallen, wenn man nicht Obacht gibt. Gerade wenn viel Bewegung bzw. viele Positions- und Szenenwechsel im Video gezeigt werden, muss man noch sensibler vorgehen.

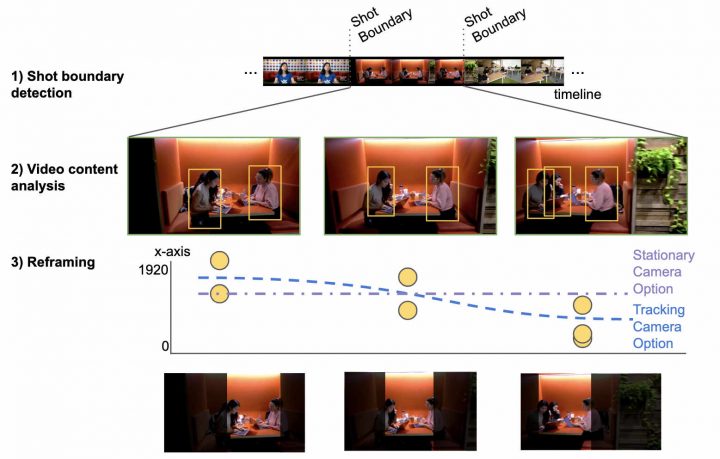

Wer selbst mal ein Video bearbeitet / geschnitten hat, kennt das: In der einen Aufnahme schneidet man links ein wenig weg, in der anderen rechts und bei einer anderen führt man eher einen Zoom aus, um den gewünschten Bildeindruck zu erhalten. AutoFlip von Google stellt nun ein Framework für automatisches Video-Reframing dar, welches auf MediaPipe aufbaut. Ihr könnt dabei ein Video hernehmen und das gewünschte Format angeben. Anschließend analysiert AutoFlip euren Clip für eine optimale Herangehensweise und gibt euer neues Video im eingestellten Format aus.

Warum soll das besonders gut funktionieren? Nun, laut Google schnipsele AutoFlip eben nicht standardisiert am Bild herum, sondern erkenne wichtige Objekte und Bildinformationen. Der Algorithmus „versteht“ quasi, was unbedingt gut im Bild bleiben muss und was nicht. Dafür nutzt man auch Deep-Learning-Techniken. Erkannt werden z. B. Menschen, Tiere aber auch Unternehmens-Logos oder Text-Overlays, die eingebunden worden sind. Auch bestimmte Bewegungen, etwa von Bällen (wichtig für Sport) beherrscht AutoFlip.

AutoFlip entscheidet sich dabei für eine von drei Reframing-Strategien: Stationär, Panning oder Tracking – je nachdem wie die Bewegungen bzw. eben Nicht-Bewegungen der Objekte erkannt werden. Je nachdem, welchen Modus AutoFlip für den jeweiligen Abschnitt für ideal hält, erfolgt dann eben das Verfolgen von Objekten und das entsprechende Cropping. Das bedeutet auch: Das automatische Cropping folgt eben Bewegungen Frame-by-Frame – das wäre von Hand eine enorme Arbeit.

Da AutoFlip Open Source ist, kann jeder damit arbeiten. Was es noch zu tun gibt? Laut Google komme ja Machine Learning zum Einsatz und daher gebe es natürlich auch bei AutoFlip die Möglichkeit die Erkennung durch mehr Daten zu verbessern. Ein zentrales Problem sei beispielsweise dann gegeben, wenn an den Bildschirmrändern wichtige Overlays erscheinen – etwa ein YouTube-Kanal-Logo. Dann werden diese via AutoFlip oft herausgeschnitten und müssen neu eingefügt werden. Zudem wäre es für die Zukunft sinnvoll, den Bildbereich auch erweitern zu können – durch Deep-Uncrop-Techniken.

Google arbeite weiterhin daran AutoFlip zu verbessern und freue sich nun auf weitere Rückmeldungen durch Entwickler und Filmemacher aus der Open-Source-Community.

Selbst schuld wenn man Geräte kauft mit dem x-ten Format… dieser Formatwahnsinn artet so aus wie die Unzählichen anderen Müll-Sachen im Tech Bereich.

Gibt es bereits eine Webcam, die automatisches Video-Reframing unterstützt, so dass die Person vor der Kamera immer gut im Bild sitzt?