Facebook spricht über Verantwortung in Sachen Sicherheit, Datenschutz und Fake News

Technologieunternehmen werden immer genau unter die Lupe genommen, was deren Handhabe beim Lösen von Problemen angeht, so Facebook. Daher wolle man in einer Art „Gegendarstellung“ nun auch mal über die Fortschritte sprechen, die man als Unternehmen machte und die vielleicht auch „positive Auswirkungen in Schlüsselbereichen“ zeigten. Das kann zum Beispiel der Bereich Datenschutz sein, aber auch Sicherheit und Gefahrenabwehr.

Knapp 40.000 Menschen arbeiten an der Sicherheit Facebooks, mit üppigen finanziellen Mitteln, die man dafür seitens des Konzerns bereitstellt. Inzwischen steht da neben dem Team auch „fortschrittliche KI“ zur Seite, die unter anderem beim Blockieren gefälschter Konten hilft oder proaktiv auch Hassreden entfernt. Man entferne nun 15-mal mehr solcher Inhalte auf Facebook und Instagram, als zur Einführung der Meldepflicht in 2017.

Ein weiteres Steckenpferd sei der Kampf gegen Fake News – ein Problem, auch außerhalb des Internets. Man habe inzwischen einige Systeme entwickelt, die dabei helfen sollen, falsche und schädliche Informationen zu entfernen. Darunter in letzter Zeit sehr populär falsche Informationen zu COVID-19 bzw. Impfstoffen. Hierzu hat man ein globales Netzwerk von mehr als 80 unabhängigen Faktenprüfern aufgebaut, die Beiträge in mehr als 60 Sprachen beurteilen. Knapp 190 Millionen COVID-bezogene Inhalte habe man da aufgrund von falschen, teilweise falschen Informationen entfernt – darunter auch solche, die verändert oder aus dem Kontext gerissen wurden. Im Gegenzug habe man bezüglich COVID-19 sogar noch mit glaubwürdigen Informationen mittels Pop-ups und Co gegen gewirkt. Ähnliches hatte man auch schon bei der US-Wahl 2020 verfolgt.

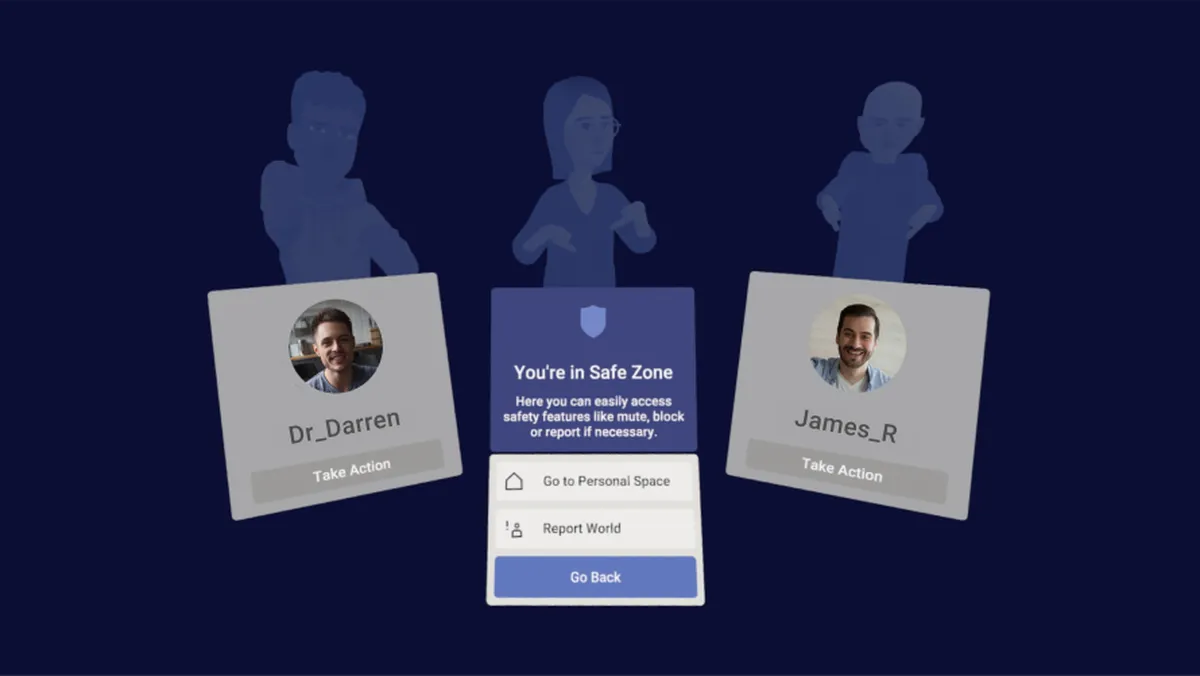

Facebook sei zudem sehr bestrebt, bei neuen Produkten oder Funktionen viele Dinge in Sachen Privatsphäre-Schutz direkt zu beachten. Man führt hier als Beispiel die Live-Audio-Räume an. Hier schließt man Personen aus, die einen Schwellenwert mit Verstößen gegen Community-Standards erreicht haben. Zumindest davon Audio-Räume zu erstellen oder in Räumen zu sprechen. Zudem gibt man den Gastgebern einige Rechte, um Sprecher als Zuhörer zu degradieren oder jene sogar komplett aus Räumen auszuschließen. Für Facebook Horizon hatte man schon in der Beta „Safe Zones“ zum Pausieren, Blockieren, Melden oder Stummschalten in der VR-Welt eingebaut.

Man sei seitens Facebook dabei, kontinuierlich weiterzuforschen und mit Experten sowie politischen Entscheidungsträgern zu kooperieren, um Probleme zu finden oder jene zu beheben. Man gesteht sich da auch ein, dass es immer Dinge gibt, die man übersieht…

Transparenz: In diesem Artikel sind Partnerlinks enthalten. Durch einen Klick darauf gelangt ihr direkt zum Anbieter. Solltet ihr euch dort für einen Kauf entscheiden, erhalten wir eine kleine Provision. Für euch ändert sich am Preis nichts. Partnerlinks haben keinerlei Einfluss auf unsere Berichterstattung.

Das ist so, als würde der Teufel über das „Vater Unser“ philosophieren 😀

Musste dabei gleich an einen zuvor gelesenen Artikel vom BR denken. Anstatt über eigene Fehler zu sprechen und sich zu entschuldigen, würde Facebook zukünftig lieber über sich sprechen und Werbung in eigener Sache machen. Passt hier schon ganz gut.

https://www.br.de/nachrichten/netzwelt/facebook-versinkt-in-skandalen-neuer-boykott-steht-kurz-bevor,SjiqfmW

Solange es für x-beliebige Unternehmen möglich ist, anhand gesammelter Tracking-Daten manuell herauszufinden um welche Reale Person es sich handelt und diese Daten vollkommen schutzlos missbräuchlich verwendet werden können, ist hier gar nichts sicher