MEMS-Mikrofone angreifbar: HomePod, Google Home und Smartphones können per Laser aus der Ferne Befehle empfangen

Es ist schon etwas merkwürdig zu lesen, dass sich smarte Geräte, wie Google Home, Apples HomePod, aber auch Smartphone und Co. per Laser dazu bringen lassen sollen, aus der Entfernung Sprachbefehle anzunehmen und deren Inhalte auszuführen. Doch wie Ars Technica berichtet, ist ein paar Forschern genau das gelungen. Die Schwachstelle sollen hier die verwendeten MEMS-Mikrofone (micro-electro-mechanical systems) sein.

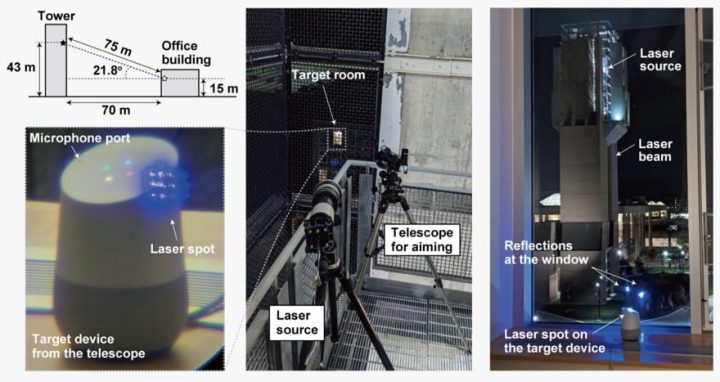

Ein Angreifer kann dies für sich nutzen, sofern er die Möglichkeit hat, das anzugreifende Gerät in freier Sicht zu erfassen und dann mit einem Laserstrahl (im Testaufbau habe dazu sogar ein 18-Dollar-Laserpointer ausgereicht) exakt das Mikrofon ins Visier zu nehmen.

Sind diese Bedingungen erfüllt, kann über den Lichtstrahl ein Audiosignal in Form des Sprachbefehls an das Mikrofon übermittelt ( „Light Commands“ genannt) werden (in Experimenten fanden die Forscher heraus, dass, wenn sie einen Laser auf ein Mikrofon richteten und die Intensität auf eine bestimmte Frequenz änderten, das Licht irgendwie die Membran des Mikrofons bei einer bestimmten Frequenz stören würde.).

Das Ergebnis: Siri öffnet das smarte Türschloss am Hauseingang – oder Google Home die Garage, der Angreifer kann ins Haus (sofern kein zusätzlicher Pin oder Ähnliches abgefragt wird, viele Geräte bieten das ja an). Auch wenn dieses Szenario durchaus diskutiert werden kann, beschreibt es doch ganz gut, warum jene Schwachstelle in Zeiten von smarten Haushalten nicht unerwähnt bleiben sollte. Laut Ars Technica arbeiten die Forscher aber bereits gemeinsam mit Apple, Google und Amazon an einer Lösung des Problems.

Ein Google-Sprecher sagte WIRED in einer Erklärung, dass man eine genaue Überprüfung der Forschungsergebnisse vornehme. „Der Schutz unserer Benutzer ist von größter Bedeutung, und wir suchen ständig nach Möglichkeiten, die Sicherheit unserer Geräte zu verbessern.“ Apple lehnte einen Kommentar ab, und Facebook reagierte bislang nicht. Ein Amazon-Sprecher schrieb in einer Erklärung, dass „wir diese Forschungsergebnisse überprüfen und weiterhin mit den Autoren zusammenarbeiten, um mehr über ihre Arbeit zu erfahren“.

Die potenziellen Schäden reichen von der Auslösung intelligenter Haussteuerungen wie Türschlösser und Thermostate bis hin zur Fernentriegelung von Autos. „Es ist das gleiche Bedrohungsmodell wie jedes andere Sprachsystem, aber mit einem ungewöhnlichen Entfernungseffekt“, sagte einer der Wissenschaftler in einem Interview. Einige Geräte bieten Authentifizierungsschutz, der einen Angriff via Laser vereiteln kann. iPhones und iPads erfordern, dass sich ein Benutzer vor dem Kauf mit TouchID oder FaceID identifiziert. Und die Forscher merken auch an, dass für die meisten Sprachassistenten von Smartphones die „Wake-Wörter“, die mit einem Sprachbefehl beginnen, mit der Stimme des Telefonbesitzers gesprochen werden müssen, was ihren Laserangriff viel schwieriger macht.

Technisch ist das ja schon genial, wenn auch vermutlich nur für sehr zielgerichte Angriffe zu verwenden.

Mich würde bei den Dingern im Haus ja eher stören, dass da irgendwas permanent mitlauscht und man nie weiss, wann da was verwendet wird.

Und wenn ich mir anschaue, welche Begehrlichkeiten die vorhandenen Daten wecken (https://www.washingtonpost.com/technology/2019/11/02/police-think-amazons-alexa-may-have-information-fatal-stabbing-case/), dann ist mir persönlich lieber, meine Privatsphäre bleibt ein wenig gewahrt.

Es lauscht nicht mehr mit als bei deinem Smartphone, das du permanent am Mann hast.

Klar, wenn man hey siri, hello google und was weiss ich anhat, dann ist das keinen Deut besser 🙂 Wohl sogar viel schlimmer …

Hätte hätte Fahrradkette…….. wie groß ist wohl die Wahrscheinlichkeit, das ein Angreifer „freie Sicht“ bekommt? Richtig, die tendiert gegen 0.

Ganz viel Geschrei um gar nichts.

Dieser „Forscher“ nimmt sich selbst viel zu wichtig.

Es ging um „Machbarkeit“, nix „Praxis“… 😉

Es gibt Drohnen, Laser und Kamera dran und los gehts. Ist dein Rolladen oben, hab ich freie Sicht. Schwieriger aber bestimmt nicht unmöglich.

Und an deiner Drohne hast du nen Lautsprecher und brüllst dann nen Befehl durchs geschlossene Fenster, ja?

Du hast die News wohl nicht ganz gelesen/verstanden?

Freie Sicht, heißt Fenster offen, keine Gardine o.Ä. dazwischen.

Keine Ahnung wie und wo Du wohnst, bei mir ginge das ohne Probleme. Unser Erdgeschoss besteht aus mehr Glas als Stein, vom Garten hat man freie Sicht in Küche und Wohnbereich. In der Küche steht ein Echo, den könnte ich nirgendwo hinstellen, wo er nicht von außen sichtbar wäre.

Allerdings wäre ich nicht so bescheu^w unvorsichtig, irgendwas Sicherheitsrelevantes darüber zu steuern.

Wenn der Laser erst das Glas trifft, funktioniert dieser Angriff nicht.

Kann man die Assistenten mit aufgenommen und wieder abgespielten Aufweckwörter auch „überlisten“?

Ja, das geht natürlich. Bloß, sollte man halt nichts wirklich Sicherheitsrelevantes über Sprachassitenten steuern.

Stellt euch vor, jemand überträgt:

„Hey Google! Selbstzerstörung!“

Nicht auszudenken… :-/

https://youtu.be/EO9x0y5lqD0

oO

Das geht auch deutlich einfacher!

https://youtu.be/KP1nLxXQU5A

(ab Minute 5:00)

Peinlich, wenn das Ü50-Publikum über ein Gerät lacht, das die nicht im Ansatz verstanden haben, noch mal selbst in der Hand gehabt haben…

Vielleicht solltest du Alexa mal nach der Definition von Satire befragen. Alleine scheinst du ja nicht drauf zu kommen.

Hallo, kennt jemand eine Erweiterung oder Skill, mit dem man alles aufzeichnen kann, was während der eigenen Abwesenheit gesprochen wird? Ich glaube, dass meine Freundin fremd geht.

> Das Ergebnis: Siri öffnet das smarte Türschloss am Hauseingang

Witzig wie der HomePod im Paper nicht vorkommt. Vielleicht weil die Forscher wußten dass der keine schlauen Türschlösser aufmacht. Der Sprachbefehl muß in jedem Fall auf dem Smartphone bestätigt werden.

„Es ist schon etwas merkwürdig zu lesen, dass sich smarte Geräte, wie Google Home, Apples HomePod, aber auch Smartphone und Co. per Laser dazu bringen lassen sollen…“

Wieso ist das merkwürdig? „Smarte“ Geräte sind eben nicht intelligent und selbst der vorgeblich intelligente Mensch lässt sich oft mit einfachsten Mitteln hinters Licht führen.