KI-Sicherheit: OpenAI führt Jugendschutz für ChatGPT ein

Nach einiger Zeit der Entwicklung hat OpenAI jetzt die angekündigten Jugendschutzfunktionen für ChatGPT ausgerollt. Die neuen Einstellungen stehen ab sofort für die Webversion zur Verfügung, die mobile Variante soll in Kürze folgen.

Die Implementierung erfolgt dabei über ein Opt-in-System: Eltern benötigen einen eigenen Account und Teenager müssen der Verknüpfung aktiv zustimmen. Das kann entweder durch eine Einladung der Eltern oder durch eine eigene Initiative des Teenagers geschehen. Die Verbindung lässt sich jederzeit wieder lösen, wobei die Eltern darüber informiert werden.

Introducing parental controls in ChatGPT.

Now parents and teens can link accounts to automatically get stronger safeguards for teens. Parents also gain tools to adjust features & set limits that work for their family.

Rolling out to all ChatGPT users today on web, mobile soon. pic.twitter.com/kcAB8fGAWG

— OpenAI (@OpenAI) September 29, 2025

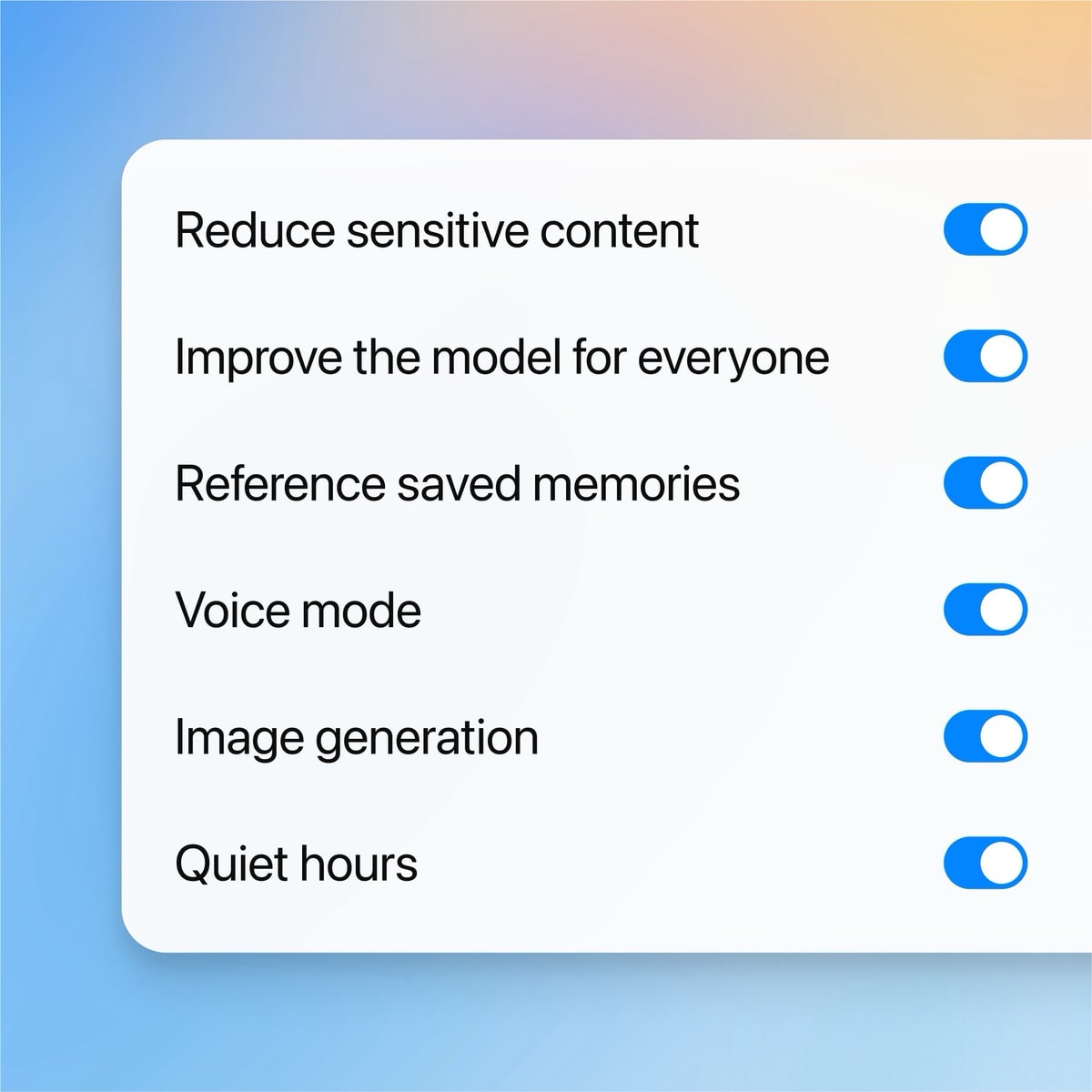

Eltern haben keinen Zugriff auf die Chatverläufe ihrer Kinder. Nur in schwerwiegenden Fällen, wenn das System oder geschulte Prüfer Sicherheitsrisiken erkennen, erfolgt eine Benachrichtigung mit den notwendigsten Informationen. Standardmäßig werden bei verknüpften Konten sensible Inhalte gefiltert. Eltern können zusätzlich die Chatverläufe aus dem Gedächtnis von ChatGPT löschen lassen, die Bildgenerierung deaktivieren und Ruhezeiten festlegen.

Transparenz: In diesem Artikel sind Partnerlinks enthalten. Durch einen Klick darauf gelangt ihr direkt zum Anbieter. Solltet ihr euch dort für einen Kauf entscheiden, erhalten wir eine kleine Provision. Für euch ändert sich am Preis nichts. Partnerlinks haben keinerlei Einfluss auf unsere Berichterstattung.

![INIU Wireless Charger Stand, [Weiße, 15W] Induktive Ladestation Schnelles Qi Zertifiziert für iPhone 17 16 15 14...](https://m.media-amazon.com/images/I/410iGYBQJ4L._SL160_.jpg)

Eltern haben keinen Zugriff auf die LLM Verläufe ihrer Kinder. … wohl aber irgendwelche cheapen Clickworker die für einen Subsubsub-Unternehmer in einem shady Callcenter-Setup die propritären Moderationsroutinen abarbeiten.

Sehr vertrauenswürdig. 😀

Alles so cheap, weil die Kunden das lieben und alles für lau haben möchten.

Finde ich auch etwas fragwürdig. Und das Kind kann die Verbindung wieder trennen, weis nicht. Das ist KI… eines der besten LLMs Weltweit, wenn nicht das beste, da sollte man doch mehr Custom vorgeben können und dann zumindest als Elternteil eine Meldung bekommen?

Die Eltern werden bei einer Trennung doch informiert. Steht im 1 Absatz.

Die Logik der Umsetzung versteh ich auch nicht.

Weil ein pubertierender Teenager den die Eltern eh nur Nerven (aus seiner sicht) so was ja möchte und einer Einladung zustimmt? Ja ne, ist klar.

Und wenn nicht, was bleibt den Eltern dann? Bedingungsloses vertrauen im Umgang mit der KI oder die wegnahme sämtlichen medien das sich das kind dann auf keinen fall an ChatGPD wenden kann?

Ist zwar schön für die kids das die Eltern nicht kontrollieren könne und Schaft mehr Privatsphäre und das die Eltern ihnen da vertrauen müssen und die KI hoffentlich einschreitet in schweren fällen. Wobei da die Frage ist was schwere fälle sind?

Auf der anderen Seite wäre es wesentlich zielführender ihnen einen Einblick in den Verlauf zu gewähren um ihre Kinder besser zu verstehen bzw. auch rechtzeitig einschreiten zu können. Warum muss da ein Dritter Drüber schauen?