Forscher zeigen, dass KI Gehirnströme auslesen und mit Bildern assoziieren kann

Ja, künstliche Intelligenzen werden aktuell mit Sicherheit viel häufiger thematisiert, als es dem einen oder anderen recht sein mag. Dennoch sollte man nicht alles daran verteufeln, wie nun auch ein Forscherteam der National University of Singapore, der Chinese University of Hongkong und der Stanford University gezeigt hat.

Das Team hat es geschafft, eine KI darauf zu trainieren, Bilder, die von Menschen betrachtet werden, nur anhand der gemessenen Hirnströme mit einer ziemlichen hohen Genauigkeit wiederzugeben.

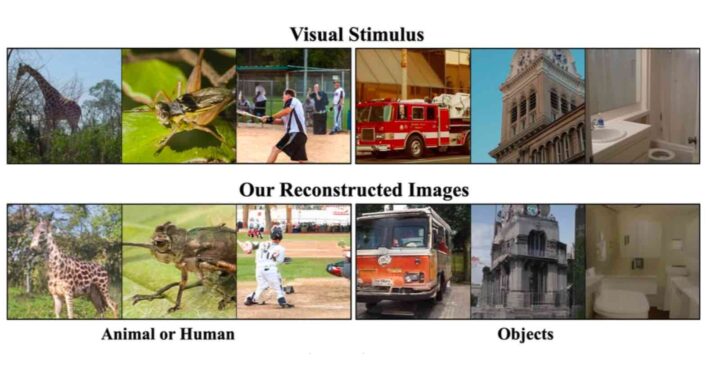

Die Teilnehmer der Studie haben in einem fMRI-Gerät (funktionelle Magnetresonanztomographie) mehr als 1.000 Bilder betrachtet, das Gerät hat die Gehirnströme aufgezeichnet und diese Signale dann durch ein KI-Modell gejagt, damit dieses bestimmte Muster mit bestimmten Bildern assoziieren lernt. Unter den vielen Bildern befanden sich ein rotes Feuerwehrauto, ein graues Gebäude, ein Baseballspieler und eine Giraffe, die Blätter frisst. Im Anschluss wurden den Probanden neue Bilder gezeigt. Das System erkannte die Gehirnströme der Patienten und erstellte eine Kurzbeschreibung der Bilder, zu denen die Gehirnströme gehörten.

Anschließend verwendete das System einen KI-Bildgenerator, um das Bild zu erzeugen, von dem es annahm, dass der Teilnehmer es sah. Angeblich sollen die erzeugten Bilder in etwa 84 % der Fälle mit den Attributen wie Farbe und Form sowie mit der semantischen Bedeutung des Originalbildes übereingestimmt haben. Laut dem Forscherteam gehe man davon aus, diese Technologie nun binnen der nächsten 10 Jahre marktreif zu haben, sodass sie jedermann nutzen könnte.

Nützlich wäre das System unter anderem in Zusammenarbeit mit Menschen mit körperlichen Beeinträchtigungen bzw. kommunikativen Einschränkungen. Noch etwas weitergesponnen könnte diese Technologie irgendwann dafür sorgen, dass Menschen keine Smartphones mehr benötigen würden, so einer der Forscher, sondern stattdessen einfach über Gedanken kommunizieren.

Transparenz: In diesem Artikel sind Partnerlinks enthalten. Durch einen Klick darauf gelangt ihr direkt zum Anbieter. Solltet ihr euch dort für einen Kauf entscheiden, erhalten wir eine kleine Provision. Für euch ändert sich am Preis nichts. Partnerlinks haben keinerlei Einfluss auf unsere Berichterstattung.

Man könnte ggf. auch Täter bei einem Verhör überführen, wenn man z.B. feststellt, dass Detailwissen vorhanden ist, also bei der Befragung gewisse Bilder im Kopf des Verdächtigen entstanden sind. Oder man könnte Werbung „optimieren“ indem man feststellt wie welche Narrative die gewünschten Bilder im Kopf herstellen oder oder oder. Spannend aber auch erschreckend…

Ich sehe schon Folgendes auf uns zukommen: „Denkt ihr Partner wirklich nur an sie? Finden sie es heraus mit der neuen BrainCheck App!“

„Minority Report“ gesehen?

Ist das ein Aprilscherz?

Der Lügendetektor aus den urbanen Legenden wird wahr.

Ich hoffe auf die umgekehrte Funktionsweise: wenn die KI Bilder einer Kamera so in die Muster übersetzen kann, die im Gehirn entstehen … vielleicht ist dann die Sehprothese – und nicht nur zwar kosmetisch ansprechende, aber sonst funktionslose Augenprothesen aus Glas – wirklich irgendwann in Reichweite … Technik ist ein Werkzeug: selbst ein chirurgisches Werkzeug kann töten oder heilen. Der Wille der das Messer führt ist das Gute ober böse, nicht das Messer. Das wird bei diesen „oh wie schlimm, eine neue Technik“ immer wieder außer Acht gelassen: man will die maschine verhindern, niemand diskutiert warum Menschen Maschinen mißbrauchen und wie man den Mißbrauch und nicht die Maschine verhindern kann.

Ich sag es euch, ChatGPT wird die ganzen KIs auf dem Markt irgendwan schlucken und die Welt regieren.