GPT-5: GitHub-Seite verrät kommende Modelle

Microsoft hat ja bereits per Changelog verraten, dass GPT-5 im Assistenten Copilot Einzug halten wird. Zu früh verraten hat man das Ganze auch bei GitHub. Genaue Benchmarks fehlen natürlich, aber die temporär aufgetauchte Seite verriet kurzzeitig die kommenden Modelle – und wofür sie gedacht sind. Das Update bringt Verbesserungen in den Bereichen logisches Denken, Code-Qualität und Benutzerfreundlichkeit mit sich. Die neue Version verarbeitet komplexe Programmieraufgaben mit minimalen Anweisungen und liefert verständliche Erklärungen.

- GANZ GROSS. IN GANZ KLEIN. – Der viel leistungsstärkere, viel kleinere Mac mini Desktop-Computer: 12,7...

Das Hauptmodell GPT-5 konzentriert sich auf logische Aufgaben und mehrstufige Prozesse. Mit GPT-5-mini steht eine kostengünstige Version für preissensitive Anwendungen zur Verfügung. GPT-5-nano wurde für schnelle Verarbeitungszeiten optimiert und eignet sich für Anwendungen, die geringe Latenzzeiten erfordern. Die Chat-Variante GPT-5-chat richtet sich an (auch an) Unternehmen und unterstützt fortgeschrittene, natürliche und kontextbezogene Gespräche mit multimodalen Fähigkeiten.

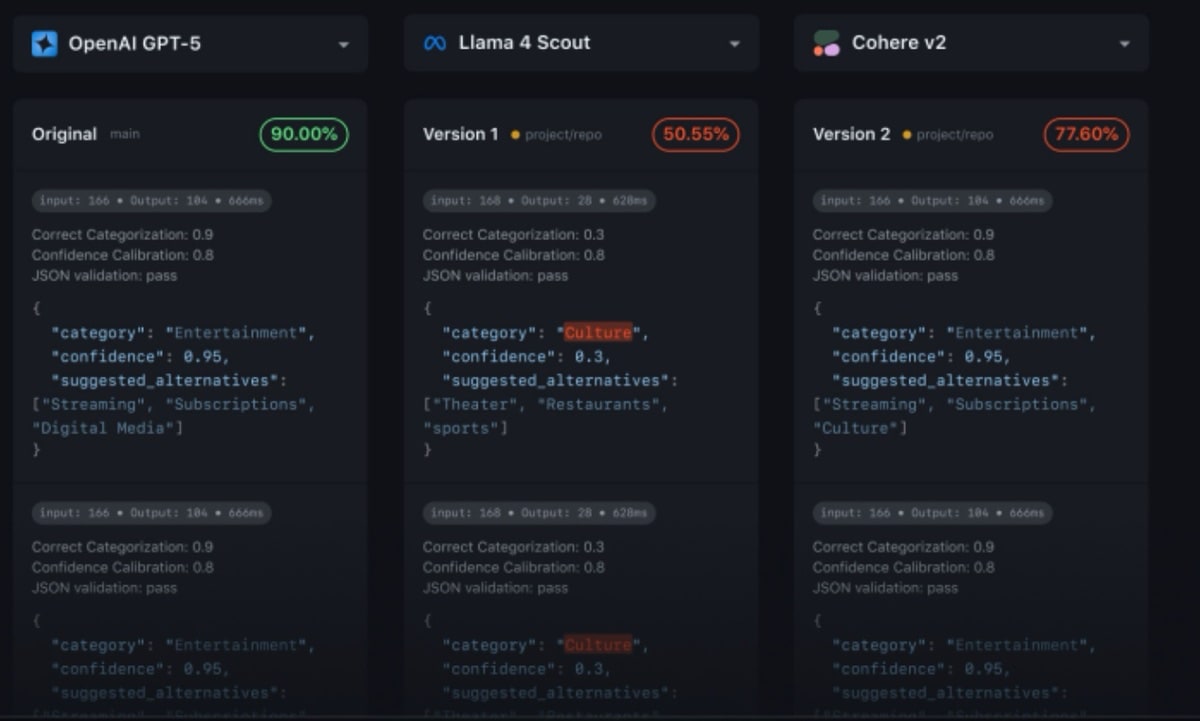

Nutzer können später GPT-5 direkt im GitHub Models Playground testen oder über die GitHub API in ihre Projekte einbinden. Die Plattform ermöglicht das Experimentieren mit Beispiel-Prompts und die schrittweise Verfeinerung eigener Ideen. Neben den OpenAI-Modellen stehen auch Alternativen von Cohere, DeepSeek, Meta und Microsoft zur Verfügung.

Offiziell werden wir GPT-5 heute Abend ab 19 Uhr vorgestellt bekommen. Dann werden sicherlich noch mehr Details ans Licht kommen.

Transparenz: In diesem Artikel sind Partnerlinks enthalten. Durch einen Klick darauf gelangt ihr direkt zum Anbieter. Solltet ihr euch dort für einen Kauf entscheiden, erhalten wir eine kleine Provision. Für euch ändert sich am Preis nichts. Partnerlinks haben keinerlei Einfluss auf unsere Berichterstattung.

Joa der Hype ist vorbei, Standardaufgaben sind mit KI ganz nett, der Rest ist weiterhin irgendwie ernüchternd. Bin gespannt wo es hin geht, abseits des Content-Klaus. Denn wie neulich schon mal wer schrieb… die scheinen ja wirklich schon alles illegal gescannt und abgegrast zu haben. Was machen sie also jetzt?

Bitte definiere Standardaufgaben?

Ich arbeite tagtäglich mit GPT-4.

Nicht nur Bürokram, sondern auch Programmierung von Apps und Webseiten.

Ich denke der Hype fängt erst noch an.

Hast Du mal konkrete Beispiele?

Mir erschließt sich das tagtägliche nicht. Nutze auch GPT-4 für die Programmierung, aber nur für den ein oder anderen Code-Snippet. Tagtägliche Nutzung kommt dabei nicht zu stande und ich wüsste auch nicht, wie man damit „richtig“ programmieren soll.

Aber da ich nicht allwissend bin, frage ich.

Ich verwende auf meinem Mac beispielsweise Raycast, in das GPT-4 integriert ist. Beim Lesen von Nachrichten lasse ich mir Inhalte per Tastenkombination in Sekundenschnelle zusammenfassen. So kann ich effizienter durch die Vielzahl an Artikeln navigieren.

Auch bei der Übersetzung von Texten verschiedener Sprachen leistet mir das Tool wertvolle Dienste – das Vorgehen ist identisch und spart erheblich Zeit.

Beim Programmieren lasse ich die KI regelmäßig meinen Code analysieren, um mögliche Fehler oder Optimierungspotenziale frühzeitig zu erkennen.

Kannst ja mal Codex und RovoDev testen dafür. Finde schon, das es für Bugsuche oder mögliche Erweiterungen teils gute Vorschläge macht

Vielen Dank.

Das schaue ich mir mal an.

Es gibt noch kaum spezialisierte Anwendungen. Da ist noch einiges an Luft nach oben. Was wir so nutzen ist ja ultra generell mit kaum tools und Zusatzfunktionen. Wenn man Claude Code sehr aufwendig aufsetzt mit MCPs, Daten, Beispielsätzen, prompts usw. dann bekommt man eine Idee, wie viel da noch rausgeholt werden kann. Wir natürlich bald jemand in einen Service integrieren, sodass man das alles nicht mehr selber machen muss.