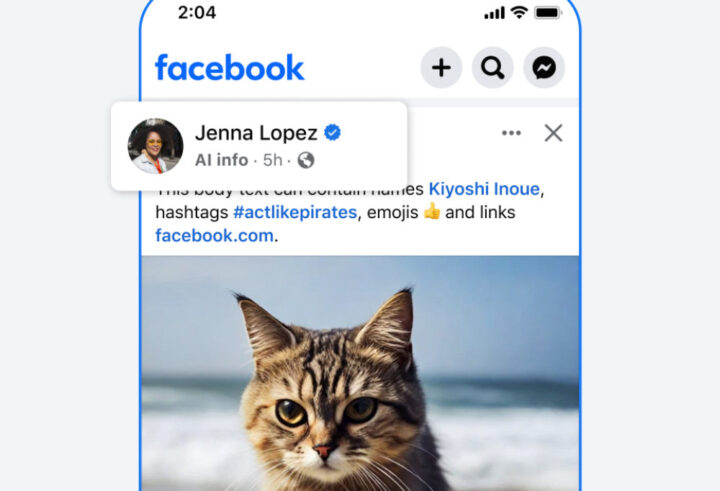

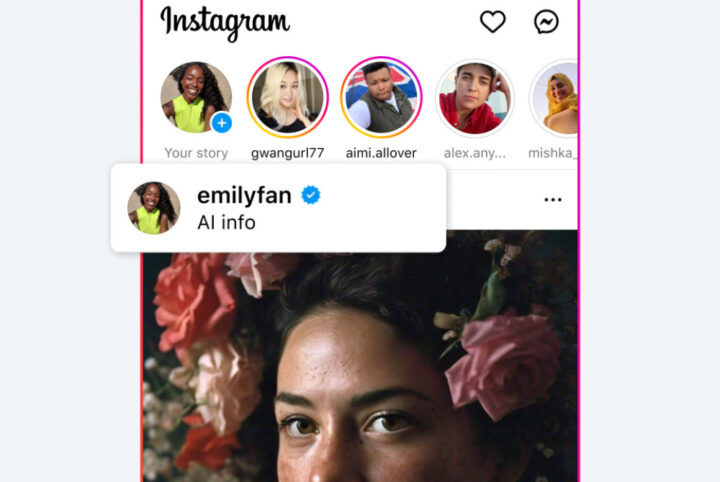

Meta passt die Kennzeichnungen von KI-Bildern an

Nach Kritik von Fotografen ändert Meta seine Kennzeichnungs-Labels für KI-generierte Bilder. Denn auch Fotos, die nur nachbearbeitet wurden, kennzeichnete Meta bisher oftmals mit dem Label „Made with AI“. Deswegen setzt man nun auf die Markierung „AI Info“. So wurden etwa vorher auch Fotos als durch KI erstellt markiert, selbst wenn die Fotografen echte Fotos nur durch die generative Erweiterung des Hintergrundes bearbeitet hatten.

Offenbar lösten die Tools von Adobes Photoshop die Markierung bereits aus, selbst wenn nur eine minimale Erweiterung des Backgrounds stattgefunden hatte. Solche Fotos bleiben wohl auch jetzt nicht von dem AI-Label verschont, aber zumindest passt das Wording etwas besser. Eine perfekte Lösung hat man damit aber noch nicht gefunden. Denn der gemeine Leser würde hinter „AI Info“ wohl weiterführende Angaben zum Bild und dessen Erstellung bzw. KI-Bearbeitung erwarten. Tatsächlich stellt Meta diese aber gar nicht bereit. Insofern finde ich das neue Label auch eher irreführend.

Klickt bzw. tippt ihr auf „AI Info“ erwarten euch stattdessen allgemeine Beschreibungen zu generativer KI, nicht aber zum speziellen Bild. Laut Meta arbeite man aber weiterhin mit anderen Unternehmen zusammen, um das Markierungs-Procedere weiter zu verbessern. Das halte ich persönlich auch noch für dringend notwendig.

Transparenz: In diesem Artikel sind Partnerlinks enthalten. Durch einen Klick darauf gelangt ihr direkt zum Anbieter. Solltet ihr euch dort für einen Kauf entscheiden, erhalten wir eine kleine Provision. Für euch ändert sich am Preis nichts. Partnerlinks haben keinerlei Einfluss auf unsere Berichterstattung.

Ich wünsche mir eine Möglichkeit keine vollständig generierten Fotos sehen zu müssen. Wird wohl nie kommen.

Zumindest blockiere ich jede KI Frau die ich sehe. vielleicht werden mir so weniger in meinen Feed gespült.

Ich finde diese ganze Auszeichnungsidee ist ein Schritt in die vollkommen falsche Richtung. Einfach ein Shortcut aus Hilflosigkeit.

Stattdessen braucht’s halt Medienbildung. Bilder sprechen nicht die Wahrheit und haben auch noch nie die Wahrheit gesprochen.

Eine Auszeichnung ist notwendig, weil man schon jetzt kaum noch in der Lage dazu ist, KI generierte Bilder von Fotografien zu unterscheiden. Mit Fortschreiten der Technik wird das noch viel unmöglicher. Insofern ist es richtig, darauf hinzuweisen, gerade wenn es um aktuelle Berichterstattung geht.

Du bist einfach gestern, heute und morgen gar nicht in der Lage, Bilder zu identifizieren, die mit KI generiert wurden.

KI ist nur eine spezielle Art von Algorithmus. Sobald dein Pinsel die Farbe, mit der du arbeitest, nicht mehr über einen deterministischen Algorithmus auswählt, sondern über einen Algorithmus, der z.B. Methoden des maschinellen Lernens oder datengetriebene Ansätze verwendet, ist es plötzlich ein KI-Bild.

Sobald dein Finger in Google Photos den Mülleimer weg radiert, ist es ein KI Bild.

Die ganze Panik darum ist m.M.n. vollkommen übertrieben und fußt einfach in fehlender Bildung.

Seltsamer Ansatz Jannik. Selbst wenn du „halt“ Medienbildung besitzt, wirst du es doch sicher relativ unschön finden, wenn du auf KI generierte Bilder oder gar Videos hereinfällst in Zukunft. Da nützt dir auch die Bildung nichts.

Ich hoffe mal Meta arbeitet da künftig noch deutlich mehr dran. Bisher stiftet das mehr Unmut und Irritation als das es hilft. Bei mir wurden auch schon Bilder markiert, die komplett ohne generative Tools entstanden sind. Das ist schon ärgerlich und führt zu unnötigen Diskussionen und Rechtfertigungen.

Ich halte eine solche Kennzeichnung füg gefährlich. Es steigert das Risiko, dass man Bilder für echt hält, die es eigentlich sind und nur falsch gekennzeichnet wurden.

Ich sehe es genau wie Jannik in seinem Kommentaren. Es braucht Bildung und Medienverständnis, um Bilder entsprechend einordnen zu können.