Gift für generative KI: Nightshade macht Bilder fürs Training unbrauchbar

Viele Künstler sind eher unglücklich mit generativer KI: Ihre Bilder halten teilweise ungefragt und unentgeltlich zum Training der zugrunde liegenden Modelle her. Große Unternehmen bedienen sich da freimütig, um noch mehr Geld zu scheffeln. Doch den Missbrauch nachzuweisen, kann schwierig werden. Hilfreich wäre es da, wenn sich das Ganze grundsätzlich unterbinden ließe. Genau dafür haben einige Forscher eine Art „Gift für künstliche Intelligenz“ entwickelt. Passenderweise nennt sich das Tool Nightshade.

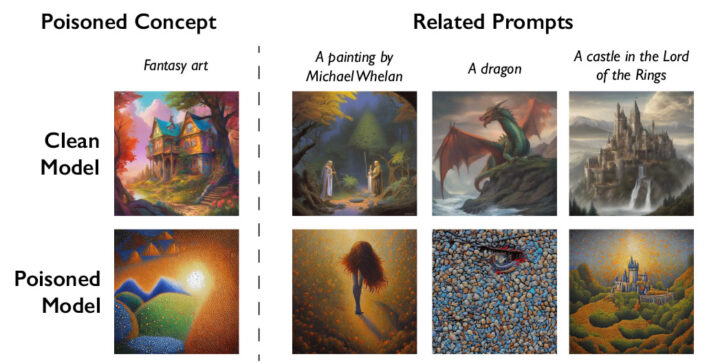

So berichtet MIT Technology Review, dass Künstler mit Nightshade für das menschliche Auge unsichtbare Anpassungen an ihren Bildern vornehmen können. Wenn die Werke aber für generative KI zum Training verwendet werden, bringen sie die Datenbasis durcheinander. Dies erzielt man durch kleine Verschiebungen im Pixelbereich. Je mehr „vergiftete“ Daten verwendet werden, desto stärker weichen die Ergebnisse der generativen KI am Ende vom eigentlich erwünschten Ziel ab.

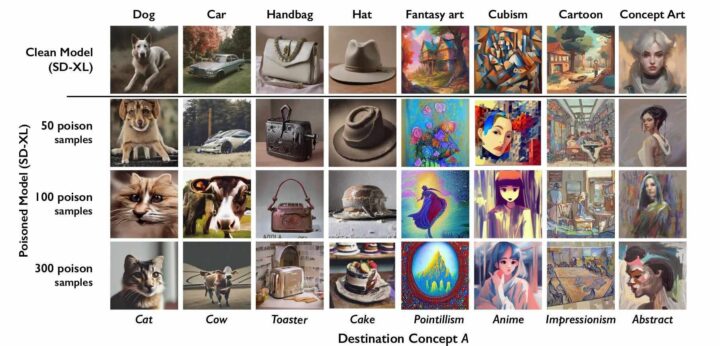

Das obige Bild zeigt die Ergebnisse gut: Schon ab 50 „vergifteten“ Samples kann etwa mit Stable Diffusion kein eindeutiger Hund mehr erstellt werden. Ab 300 modifizierten Exemplaren, kommt statt eines Hundes gar eine Katze zum Vorschein. Oder statt einer Handtasche gibt die generative KI das Bild eines Toasters aus – aus einem Hut wird hingegen ein Kuchen. Entwickelt wurde Nightshade dabei von einem Team an der Universität Chicago. Das gleiche Team hatte zuvor mit Glaze schon ein ähnliches Tool entwickelt, das Künstlern hilft, ihren einzigartigen Stil zu maskieren. Nightshade und Glaze will man daher auch miteinander verknüpfen.

Man will damit nicht generell den Fortschritt bei künstlicher Intelligenz sabotieren, aber dafür sorgen, dass die Selbstbedienungsmentalität der Firmen unterbunden wird. Nightshade soll Open Source veröffentlicht werden, sodass jeder Interessierte damit arbeiten kann. Je mehr Künstler damit ihr Urheberrecht schützen, desto geringer in Zukunft die Missbrauchsgefahr. Dabei infiziert man im Übrigen auch automatisch ähnliche Darstellungen.

Werden also infizierte Trainingsdaten für „Hund“ genutzt, werden auch nahegelegenes Objekt wie „Wolf“ oder „Welpe“ später falsch dargestellt. Allerdings ist die Wirksamkeit natürlich nicht nur davon abhängig, wie viele infizierte Bilder eingeschleust werden, sondern auch davon, wie viele Bilder als Datenbasis herhalten.

Transparenz: In diesem Artikel sind Partnerlinks enthalten. Durch einen Klick darauf gelangt ihr direkt zum Anbieter. Solltet ihr euch dort für einen Kauf entscheiden, erhalten wir eine kleine Provision. Für euch ändert sich am Preis nichts. Partnerlinks haben keinerlei Einfluss auf unsere Berichterstattung.

Das mit dem Bezahlen für das trainieren einer KI habe ich irgendwie nicht verstanden. Was ist der Unterschied zwischen einer KI die ein Bild analysiert und einem Menschen der sich von einem Bild „inspirieren“ lässt. Beide trainieren doch anhand einer Vorlage. Von der KI möchte der Künstler aber Geld haben, von dem Menschen aber nicht (zumindest wäre es mir neu, dass es so etwas gäbe).

Schwer zu definieren, da gebe ich dir Recht, aber ich würde es mal so versuchen:

Ein Mensch kann sich das Bild aus verschiedensten Gründen angucken, reine Neugier, Kunstgenuss, Zufall, whatever. Die wenigsten Betrachter sind selbst Künstler, die sich daraus Inspiration für eigene Werke „ziehen“ möchten. Selbst wenn, dann meist als Nebenzweck.

Eine KI hat nur einen Grund, das Bild zu verarbeiten, nämlich den, die eigene Leistung zu verbessern und damit für Nutzer „wertvoller“ zu werden. Damit ist dieser Vorgang immer ein Teil einer emotionslosen „Wertschöpfungskette“, an der der ursprüngliche Künstler eben seinen fairen kleinen Anteil haben möchte.

„Eine KI hat nur einen Grund, das Bild zu verarbeiten, nämlich den, die eigene Leistung zu verbessern und damit für Nutzer „wertvoller“ zu werden. “

Aha. Übrigens: Ein Schüler hat nur einen Grund das Bildungsmaterial zu verarbeiten, nämlich den, die eigene Leistung zu verbessern und sich damit für die Gesellschaft wertvoller zu machen.

Darum werden Lehrer auch bezahlt, hast du gut erkannt.

Ich versuche es mal mit folgendem Erklärungsansatz, nämlich dem Multiplikator:

Und wenn sich EIN Künstler ein Bild anschaut und dieses analysiert, dann steht das Analyseergebnis dieses EINEN Künstlers plötzlich ALLEN Internetnutzern dieses Planeten zur Nutzung zur Verfügung und der EINE Künstler verdient damit plötzlich Milliarden?

Ich habe mich auch gefragt, ob Eltern nun zahlen müssen, wenn sie Kindern zeigen, was Drachen in der Fantasy-Literatur sind.

Endlich ist technisch was möglich. Bin gespannt, wie sich das weiter entwickelt.

Gar nicht. Da man grundlegend weiterhin mit einfachen Mitteln sowas umgehen kann. Es mangelt weiter an der gesellschaftlichen Entwicklung.

> Was ist der Unterschied zwischen einer KI die ein Bild analysiert

> und einem Menschen der sich von einem Bild „inspirieren“ lässt.

Wie in vielen anderen Dingen auch: Die digitale Verarbeitung von Daten ist etwas komplett anderes als ein eizelner Mensch, der eine einzelne Vorlage auf einem einzelnen Papier nachmalt.

– Die Mona Lisa selbst nachmalen und ins Schlafzimmer hängen ist ein Hobby.

– Eine gesamte öffentliche Bilddatenbank (auf (Transfer-)kosten des Betreibers!) leersaugen und die Ergebnisse dieses Geschäftsmodells weiterverkaufen — schwierig.

Grundsätzlich fehlt uns glaubich noch das richtige Wort dafür: Es ist weder Diebstahl noch Urheberrechtsverletzung noch Plagiieren, aber auf jeden Fall wären die KI-Anbieter „nichts“ ohne die Daten, an denen sie sich ungefragt bedienen, und das sehe ich kritisch. Eine OptIn-Lösung könnte der Ausweg sein.

Der Mensch wäre ebenso nichts, ohne die Einflüsse anderer Menschen.

Eher würde hier die Frage aufkommen welchen Wert die KI innerhalb der Menschheit hat. Hier stellt sich gar die Frage, ob sie schon Rechte hat, ohne Bewusstsein zu haben, oder wer.

Eigentlich würde doch alles geschaffene den KI-Erstellern gehören. Die aber machen keine Anstalten derartiges zu fordern. Das könnte natürlich ein Trick sein, um uns erst die Rechnung zu stellen, wenn wir nicht mehr ohne können. Die Methode ist ja nicht ungewöhnlich, scheint gar Zukunft.

Aber ich kann doch genauso gut ein Mona Lisa ähnliches Portrait einer Frau malen und verkaufen. Es ist ja nicht so, dass die KI genau die Mona Lisa „nachmalen“ würde, aber ein ähnliches Bild.

Für deine nachgemalte Mona Lisa wirst Du keine 30 Euro bekommen. Wenn Du dein Bild für viel Geld verkaufen willst, dann kannst Du dich zwar inspirieren lassen, muss aber im wesentlichen eine Eigenleistung erbringen. Anderes Beispiel: Manchmal verwechselt man das Intro von zwei Musikstücken, aber dann geht es anders weiter.

Was die KI-Anbieter hier machen, ist letztlich von allen „klauen“. Das erreicht m.E. nicht die ausreichende Schöpfungshöhe für ein eigenes Werk. Das sind alles nur „Zitate“, und eine Zitatesammlung ist keine Doktorarbeit.

Kein Werk von KI kann überhaupt schöpfungshöhe beanspruchen. Das liegt daran, dass das planvolle menschliche handeln im Prozess des Erstellens fehlt. Das deutsche Recht ist da relativ klar.

Finde das Ganze doch irgendwie albern. Welcher potenzielle Käufer eines Werkes eines Künstlers würde stattdessen zu einer popeligen Verwurstung einer Ki greifen., einem „Werk“, das weder mit dem Spirit, noch dem erkennbaren Arbeitsaufwand des Originals daher kommt. Die Künster sorgen doch mit ihrer finanziellen Forderung indirekt für Abwertung ihrer Kunst.

Der Künstler ist auch keine Kopfgeburt, sondern basiert auf dem Wissen anderer. Ob jemand dafür etwas bezahlen würde, hängt von dem qualitativen Ergebnis ab. Es gibt sehr viele Kunstschaffende, doch nur wenig von diesen werden auch wirklich bezahlt. Es gab auch Künstler, die man zu ihren Lebzeiten auslachte und mit deren Werken heute Vermögen verdient werden. Liegt alles im Auge des Betrachters.

Das ist doch lediglich ein Produkt um „KI“ zu sabotieren oder gar zu manipulieren. Kunst hat nunmal auf die Zukunft Einfluss. Besonders wenn sie gut ist. Man stelle sich vor, wir würden bei jedem Menschen, nach dem Ansehen eines Bildes oder dem Hören eines Liedes, es wieder aus dem Gehirn löschen. Wir müssten ja letztlich alles löschen, weil das meiste was wir sehen jemand anderes geschaffen hat. Die Grünen würden früher oder später auch die Rechte der Natur anmelden und das Betrachten von Pflanzen löschen.

Was für ein Schwachsinn. Wer seine Kunst für sich behalten will, soll sie bitte im Keller einschließen und testamentarisch die Vernichtung beim eigenen Tot festlegen.

Du solltest schon den Kunstschaffenden überlassen, ob und in welcher Weise sie ihre Werke anderen zur Verfügung stellen. Was nach „Man stelle sich vor“ kommt, ist völliger Unsinn und hat mit dem Artikel überhaupt nichts mehr zu tun, warum sollte man sich damit beschäftigen? Aber Hauptsache noch irgendwie Deinen Hass auf die Grünen noch mit reinbringen.

Leider ist das in einer geldgeilen Welt nicht so :((

Es geht doch dabei gar nicht um „Kunst“ oder „nicht Kunst“, das lenkt doch nur ab. Es geht tatsächlich um Geld und Wertschöpfung.

Stellt euch vor, es wäre keine Bilder-KI sondern ein Kuchenback-Roboter.

Der Roboter ist gebaut, aber um guten Kuchen zu backen muss er vorher ein paar tausend existierende Kuchen probieren und vergleichen. Danach kann er dann auch Kuchen backen, nicht ganz so gut, aber schneller und billiger.

Da würde sich doch auch keiner wundern, wenn die Bäcker ein Mitspracherecht fordern, ob ihre Kuchen da auch probiert werden dürfen.

Kann man sich sowas auch für die Datenkraken Meta, Twixxer, Alpha und andere entwickeln, die deren Werbedatenbank vergiftet? Das fände ich sehr nützlich.