Google Lens soll noch besser werden

Google Lens, Googles smartes Erkennungssystem in der Kamera-App und Google Fotos, soll noch smarter werden. Das Problem bislang: Google Lens ist zwar auf Pixel-Geräten zu finden, auf anderen Geräten sah es aber mau aus. Hier will man nun nacharbeiten und Lens in mehrere Geräte bringen: LG, Motorola, Xiaomi, Sony Mobile, HMD/Nokia, Transsion, TCL, OnePlus, BQ oder auch Asus. Eine Übersicht zu Lens hatte ich hier im Blog schon gegeben, falls euch das gar nichts sagt:

Google Lens: Funktioniert es bei euch unter Android?

Google Lens unter iOS: So könnte es bei Euch auf Deutsch klappen

Google Fotos für iOS: Verteilung von Google Lens beginnt

Google veröffentlicht Updates zu Google Lens und ARCore 1.0

Google Lens wird in den nächsten Wochen an erste Nutzer mit Pixel verteilt

Google Lens wird nun auch für die erste Generation Pixel-Smartphones verteilt

Google Lens soll schon in den nächsten Wochen in den Assistenten implementiert werden

Google Lens: Auf einem Auge blöd

Google hat auch drei Updates angekündigt, die es Lens ermöglichen, mehr Fragen über mehr Dinge schneller zu beantworten.

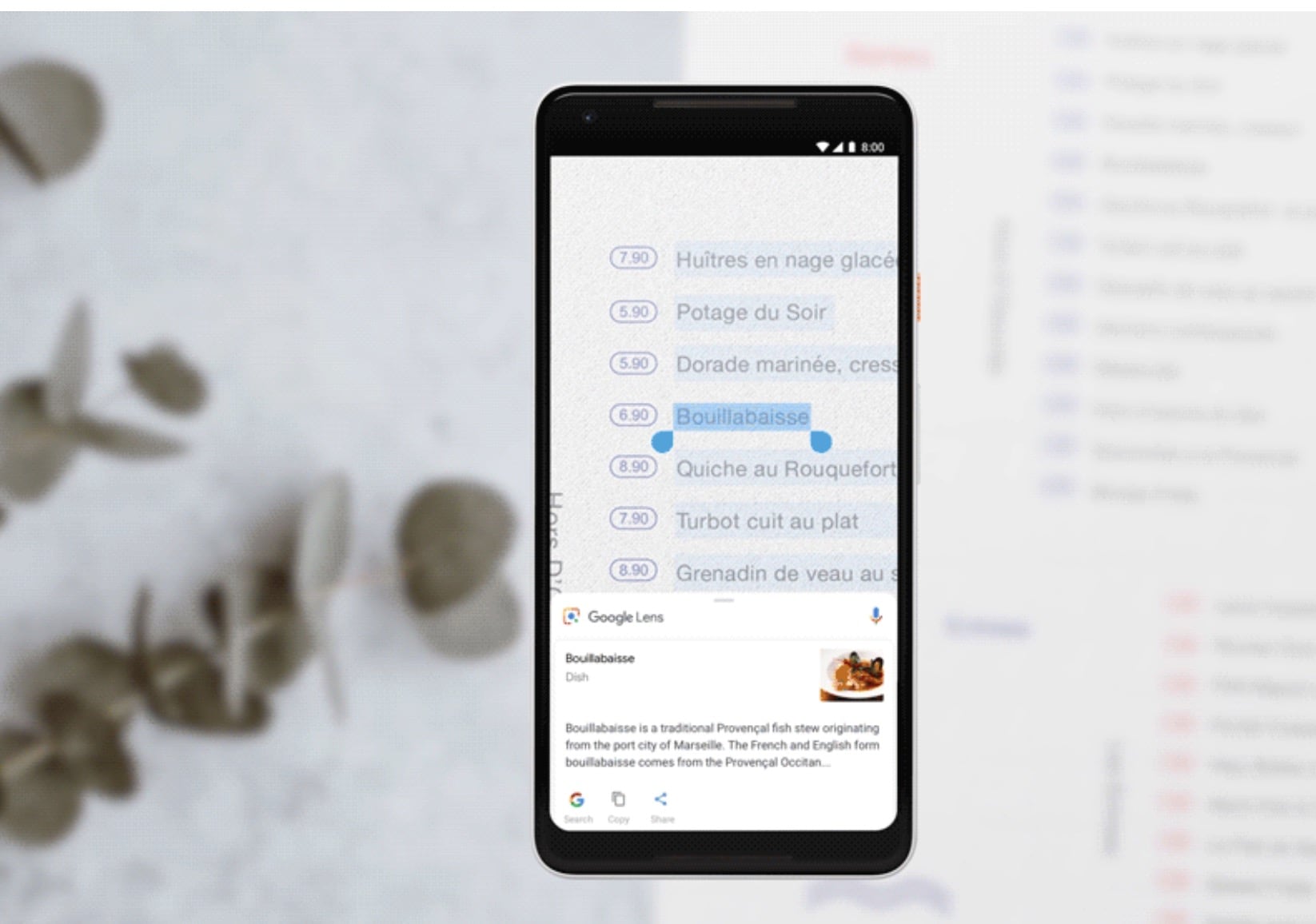

Zuerst verbindet eine intelligente Textauswahl die Wörter, die der Nutzer sieht, mit den Antworten und Aktionen. Der Nutzer kann so beispielsweise direkt Textinhalte aus Büchern über Lens in die Zwischenablage kopieren und weiterverarbeiten. Gibt es heute zwar schon über andere Apps, sind aber viel mehr Wege.

Lens hilft weiterhin, Wörter zu verstehen, indem es Nutzern relevante Informationen und Fotos zeigt. Ihr seht in einem Restaurant den Namen einer Speise, die ihr nicht kennt? Klar, kann man übersetzen und Google machen lassen – oder direkt durch Lens jagen. Schneller zum Ergebnis. Wenn es denn klappt.

Des Weiteren kann Google Lens einzelne Dinge auf Fotos erkennen und ähnliche vorschlagen lassen. Google kann beispielsweise Klamotten einer Schaufensterpuppe analysieren, dann ähnliche oder identische Teile anzeigen. In den USA gleich mit Kaufmöglichkeit – wohl wenig überraschend.

Google Lens soll nun auch in Echtzeit arbeiten. Die Kamera-App wird damit zum Tor für die Welt, wenn man dies denn will.

Ich finde das alles eigentlich eine tolle Sache. Also die Dinge, die Google in Sachen Machine Learning und AI zeigte – gerade bei Lens und Google Fotos. Das Problem ist aber, dass Google schon im letzten Jahr sehr viel zeigte – aber bisher wenig lieferte. Das muss besser werden.

Für das iPhones soll es auch bald rauskommen. Gerade nachgeschaut. Leider noch nicht verfügbar.

Sinnlos, kann ich wohl auf meinem S8 vergessen da ja Samsung mit aller Macht Bixby durchdrücken will

hab Bekanntenkreis auf Xiaomi umstellen können 😉

„… soll noch besser werden“. Das ist ja wohl ein Witz, wenn es auf der Mehrzahl der Geräte in Deutschland noch überhaupt nicht angekommen ist. 🙂

Schwer zu glauben, aber Deutschland ist nicht der Nabel der Welt. 😉