Google Pixel 3: Google-Mitarbeiter trommelt für Night Sight

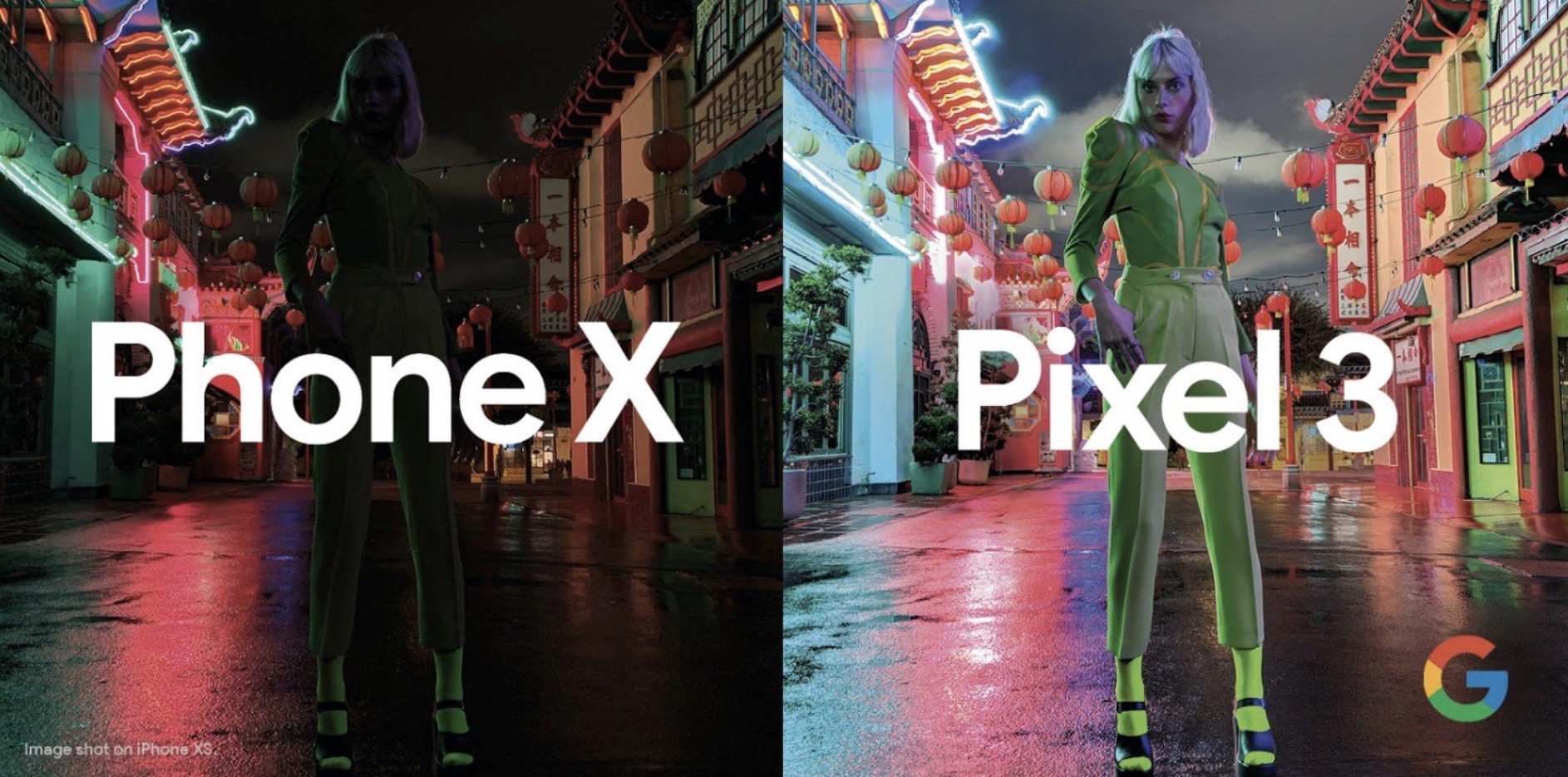

Schaut man sich das Marketing zum Google Pixel 3 an, dann geht es meist nur um die Kamera. Nicht zwei oder drei Linsen zaubern hier tolle Ergebnisse, nein – eine Kamera auf der Rückseite sorgt für durchaus beeindruckende Ergebnisse. Auch die Funktion Night Sight ist immer wieder Bestandteil, wenn irgendwo für das Pixel 3 getrommelt wird. Hierbei schafft es das Pixel 3, besonders viel aus dunklen Umgebungen zu holen. Allerdings ist das nun keine Sache, die man bei Google erfunden hat, schon mehrere Smartphones setzten vorher eine ähnliche Technik ein. Nun hat sich noch einmal Marvin Chow, seines Zeichens im Produkt-Marketing bei Google für Gmail, News, VR/AR, Assistant und Ai, eingebracht. Er will mit seinem Tweet noch einmal auf die Unterschiede zwischen iPhone XS und Pixel 3 in schummerigen Umgebungen hinweisen. Zwar steht in der Gegenüberstellung, dass man mit dem „Phone X“ vergleicht, allerdings ist im Kleingedruckten vom iPhone XS zu lesen. Zweifelsohne liegt das Pixel 3 hier vorne. Nicht vergessen sollte man aber, dass auch das iPhone XS solche Fotos machen kann. Das Problem: Google zaubert aus der „Werks-App“ solche Ergebnisse über die Night-Sight-Funktion, bei Apple müsste man zu einer anderen App greifen, um solch ein Ergebnis zu erzielen. Wer weiß: Vielleicht ist es ja gerade eine Funktion wie Night Sight, die Apple dazu bewegt, mit iOS 13 vielleicht mal etwas mehr Funktionen in die Kamera-App zu zaubern.

Und die Dame sollte während des Fotos darauf achten, sich nicht zu bewegen 😉

Funfackt, das geht bei google auch mit bewegen, die haben imerhin einen intelligenten Algorithmus entwickelt der weniger mit HDR als mit Fotocollage zu tun hat (leider, aber geil)

Mit welcher App geht das unter iOS??

Das würde mich auch interessieren.

Geht nur im Traum von Apple Fanboys.

Lightroom Camera. Kann man bis zu 1 sek lang belichten 😉 und sollte auch mit jeder anderen App gehen. Das Nachbearbeiten ist die Kunst…

Oh wow, mit meinem 200€ Androiden geht bis zu 32sek Belichtung ab werk und Google Kamera Mod inkl. Night Sight funktioniert auch.

Glückwunsch. Bis stolz auf Dich.

Ja, nicht zu vergessen von den fünf Jahren Updates die ich bekomme.

root und CustomROM sind wirklich gute Argumente, aber viele wollen einfach nur ihr Handy nutzen und sich nächstes Jahr wieder den neuesten „Sh*t“ holen.

Und es wird eben nicht lange belichtet und es ist auch kein HDR. Also Glückwunsch, Thema verfehlt und weitergehen.

Das Google Foto sieht jetzt aber auch nicht wirklich gut aus. Klar die Frau ist zu erkennen, aber dafür sind die Farben und der Kontrast nicht zu gebrauchen

Personen sind zu erkennen. Der einzig relevante Punkt für Otto Normalknipser ist damit erfüllt.

Er vergleicht mit dem „Phone X“ (ohne „i“) 🙂

Pone X bedeutet auf Deutsch ein X beliebiges Smartphone du Kartoffelbirne

Unter „Phone X“ steht genau um welches Phone es sich handelt und das ist das iPhone X.

Nein.

Mal ganz ehrlich. Beim Iphone sehe ich wenigstens, dass es nachts war. Beim Pixel 3 könnte das auch 17.00 Uhr gewesen sein. Das verzerrt ja völlig die Realität.

Es könnte ja auch umgekehrt gewesen sein. Es war 17Uhr (Winterzeit) und nicht Nacht.

Nur uninformierte Apple Fans können behaupten, dass das iPhone X auch solche Fotos machen kann. Der gravierende Unterschied zum Night Sight Modus und jeder anderen Kamera (wie z.B. iPhone X) ist, dass nicht einfach die Belichtungszeit bis ins Unendliche erhöht wird, sondern mehrere kurz belichtete Fotos mit hoher ISO „gestackt“ werden. Sowas dauert auf einem top ausgerüsteten PC mit Photoshop je nach Anzahl der Fotos einige Sekunden. Umso erstaunlicher ist also, dass Google eine Softwarelösung erfunden hat, die dieses leistungshungrige Verfahren mit Smartphone CPUs ebenso schnell bewerkstelligt.

Der Vorteil des Ganzen ist, das Verfahren ist deutlich weniger verwacklungs- und bewegungsanfällig als beim iPhone X.

Ich möchte mich für diesen Kommentar bedanken. Sehr verständlich und leicht erklärt, wo die Unterschiede liegen. Sicher kann man so eine Aufnahme auch durch eine lange Belichtungszeit machen. Aber dann verwischt halt Vieles. Die Software-Lösung erscheint mir daher sehr viel cleverer.

> Nur uninformierte Apple Fans können behaupten, dass das iPhone X auch solche Fotos machen kann.

Richtig. Das kann nur das XS. Du hast gerade die Fotografie-Pipeline des XS in Zusammenarbeit mit dem ISP im A12 beschrieben. Nennt sich Smart HD. Es hat schon seinen Grund warum der Typ von Google das iPhone X erwähnt, und nicht das XS.

Er erwähnt nicht das „iPhone X“, sondern das „Phone X“. Unten links steht aber „shot on iPhone XS“.

Spielt auch keine Rolle. Mit dem XS kann man die gleichen Resultate erzielen. Allerdings manuell in der Galerie und nicht gleich in der Kamera-App.

Du bist immer wieder der Knaller. Apple Mitarbeiter haben also in Hogwarts die Schulbank gedrückt, da sie aus einer schwarzen jpg Datei Farben und Details in der Nachbearbeitung wieder herzaubern können?

Das hast das ganze Thema Fotografie nicht verstanden, verschone uns doch mal mit deinem Apple Dogma, danke.

Jetzt kommen wir der Sache schon näher, Karl! Nachdem Du heute Nachmittag schon den Google Entwicklern „Hexenwerk“ bescheinigt hast, dürfen nun also auch die Apple Leute ein bissl mitzaubern! 😉

Schau mal unten links auf dem Vergleichsfoto 😉

Glaubst du das was du geschrieben hast?

Nein, das weiss ich. Kleiner Unterschied.

Dann ist dein Wissen falsch. Gute Besserung!

Ich möchte mal anmerken das das Huawei p20 (das normale nicht pro) das verfahren ebenfalls benutzt und ich ähnlich gute Fotos in dunkler Umgebung damit mache. Die Details und Farben leiden da nur minimal drunter. Also nicht das ich nicht mit lightRoom ausbessern ließe…

Bin Android Fan, aber die vergeblichen Versuche, das Pixel 3 irgendwie schmackhaft zu machen, zeugen nur davon, wie weit Google hinter der Konkurrenz herhinkt (Apple und Android). Computational Photography ist der falsche Weg. Ich ziehe reale Abbildungen (mit mehreren Objektiven) vor.

Prognose: Irgendwann wird Google gar nicht mehr das reale Bild speichern, weil es so schlecht ist, sondern ein viel besseres Äquivalent aus einer Datenbank.

Auch du hast nicht verstanden was image stacking ist, da ist nichts irreales dran. Es ist schockierend wie weit Google vor Apple und allen anderen ist, genauso wie es schockierend ist, das Gegenteil bei solch einer Beweislage zu behaupten.

Du bist doppelt schockiert. Ich nutze Stacking schon seit mindestens 15 Jahren für Astro Fotografie. Ich habe auch die technischen Artikel zur Funktionsweise der Google Kameras gelesen.

Jeder bildet sich eben seine eigene Meinung.

Ob etwas real oder irreal ist, darüber kann man keine Meinung haben, denn nur eines von beiden kann zutreffen. Zudem zeigt deine „Prognose“, dass du offensichtlich die technischen Artikel nicht verstanden hast.

Glauben kannst du alles was du willst, aber verunsichere nicht andere damit.

Jetzt hast Du mich aber echt verunsichert. 🙂

Karl, schön dass Du vom Pixel so überzeugt bist. Sicher ein gutes Smartphone. Aber nun tu nicht so als ob Google hier das Rad neu erfunden hat. Das ist ja ecklig. Das Stacken von mehreren kurz belichteten Fotos ist nun kein Hexenwerk und bei den CPU Leistungen (hier ist das XS übrigens weiterhin vorne) auch kein Problem. Bei Apple nennt es sich ein ähnliches Prinzip eben „Intelligente HDR“.

Ich habe nicht geschrieben, dass Google das Stacken erfunden hat. Bitte lies genauer. Du hast offenbar keine Vorstellung wie viel Leistung man zum Stacken von 8 Fotos oder mehr braucht. Da kannst du auf deinem iPhone ein paar Minütchen pro Bild warten. Den Algorithmus von Google kann man daher durchaus als Hexenwerk bezeichnen.

Was google da macht ist eben kein HDR, begreift eben nicht jeder.

Eben das schockiert mich dann aber. Bin ebenso ein paar Jahre in der Astro Fotografie unterwegs und finde diese Art der Bildverarbeitung einfach nur super und auch notwendig um einfach mehr herauszuholen. Ohne diese Bildverarbeitung würden wir am Nachthimmel mit unserer Hobbyausstattung (die auch ganz schön ins Geld gehen kann) nicht wirklich etwas sehen. Daher begrüße ich diese Entwicklung und kann die tolle Funktion an meinem Pixel 3 nur bestätigen. Ob da nun eine oder mehrere Linsen/Sensoren das Bild erzeugen ist irrelevant, das Ergebnis zählt und dieses spricht eindeutig für diese Technik.

Das Argument verstehe ich nicht. Wieso hinkt Google Apple hinterher wenn sie mit cleverer Software ein Bild erzeugen, auf dem im Dunkeln mehr zu erkennen ist, als bei Apple mit ähnlicher Hardware ohne Software? Es fällt für mich als Nutzer doch eindeutig ein „besseres“ (=nutzbares) Bild raus, das wäre auch das garantierte Ergebnis einer repräsentativen Befragung.

Wenn Apple 5 Objektive ins iPhone X3 baut, könnten sie das selbe Ergebnis nur mit Hardware erzeugen?

Ich bin mir hier nicht sicher.

Die Frage ist doch: Wer will so ein künstliches Bild, was nicht einmal gut aussieht?

Genau, hören wir einfach auf im Dunkeln Fotos zu machen, denn wenn wir nichts sehen, darf das die Kamera auch nicht. Nur Fotos wie links im Bild sehen „gut“ aus.

*Ironie*

Beide Fotos sehen schlecht aus. Ich finde das iPhone bei Dunkelheit auch für sehr mau, ich hatte da letztens erst ein passendes Beispiel. Aber das Bild der Pixeldame ist genauso Mist. Vergoldeter Mist, aber immer noch Mist.

Dann hast es noch nicht genutzt. Ich habe vor ein paar Tagen, als es abends endlich mal Schnee gab, ein Foto vom Garten gemacht. Draußen war fast gar kein Licht vorhanden, weshalb das Originalbild entsprechend schlecht bzw. fast nichts zu erkennen war. Mit Night Sight ist das komplett anders. Ein Foto, das man normalerweise auf einen Zeitpunkt mit Tageslicht und nicht mit Dunkelheit vermuten würde. Und da sah nichts künstlich oder schlecht aus..

Du willst also lieber ein schwarzes Bild wo man nichts sieht?

Also aus einem schwarzen Bild macht Google auch kein Bild, wo man etwas sieht. Und ja: Ich mache im Dunkeln lieber Fotos, wo ich die Stimmung im Dunkeln auch so einfange, wie sie ist. Wenn ich taghelle Fotos will, mach ich sie am Tag. Für mich wirkt das einfach unnatürlich und nicht wirklich schön, was Google da macht.

„Also aus einem schwarzen Bild macht Google auch kein Bild“

Wenn man es noch nie genutzt hat kommen dann solche Behauptungen.

In Situationen wo man noch nicht einmal mehr sieht dass das Gras grün ist und eigentlich nie und nimmer davon ausgeht mit einem Smartphone ein brauchbares Ergebnis zu bekommen (nicht im Sinne von auf Leinwand druckbar mit Top Qualität), bekommst du eben doch mit Night Sight ein Ergebnis was man nicht direkt wieder löschen muss.

Je mehr Licht dann zur Verfügung steht, desto besser das Ergebnis.

Du bekommst tatsächlich mehr Details (Farbdetails inkl.!) und kannst dann gerne im Nachhinein die Belichtung nach untern regeln um der tatsächlichen Stimmung gerecht zu werden.

Das Ergebnis wird letzten Endes besser ausfallen.

Zumindest das Bild der Dame gibt ganz klar nicht nicht Realität wieder und hat in meinen Augen auch keinerlei ätherischen Anspruch.

Lieber gar kein Bild, als ein schlechtes. (Und ja, beide sind schlecht.)

Wenn es nur um Dokumentation geht, dann nehme ich halt einen fetten Blitz.

@caschy: Es steht Phone X da, nicht iPhone! So geht Marketing 🙂

Genau das hat Cashy auch geschrieben 😉

Kleingedruckte nicht gelesen? „…. Shot on iPhone XS“

Text nicht gelesen?

Übrigens kann man auf dem hier eingebunden Bild quasi nichts erkennen. Auf dem Originalen sieht das schon viel besser aus und nicht so künstlich und verpixelt.

https://pbs.twimg.com/media/Dx4QoVeWkAAth2z.jpg?format=jpg&name=orig

Warum lese ich dutzende Artikel von Tech-Blogs über einen einzelnen, mehr oder weniger unbedeutenden Tweet eines Google Mitarbeiters?

Wen interessiert eigentlich so ein HDR Murks? Und dann noch das Motiv. Warum kann man nicht realistisch bleiben und eine EveryDay Situation darstellen?

Als Fotograf ist das nicht so uninteressant.

Sony macht das bei seinen cams auch. Die wollen einen noch nicht so viel Dynamik Range auf dem Blatt anbieten. Dafür entwickeln sie dann flache Profile und auto HDR um die Range künstlich hoch zu ziehen. Wenn ich ein solches Bild bearbeite, könnte das auch so aussehen wie dann vom Pixel hier. Aus dem Iphone shot habe ich diese Möglichkeit nichtmehr.

Ich gehe davon aus das das Bild aus dem Pixel 3 ein Endprodukt ist und keine Bearbeitungsvorstufe.

Das Pixel schießt eindeutig die besseren Bilder.

Ich finde est richtig lustig wie die Appel Fanboys hier irgendwelche Argumente finden müssen um ihr 1600 Euro IPhone zu rechtfertigen.

Leider ist es halt nunmal so das jede Firma bzw: Marken sich bei einer jahrelangen (Machtherschafft)

Zurücklehnt und keine Innovationen mehr bring zb die Notch die ist Katastrophal. Wer schaut sich bitte gerne Videos mit so was an? Augenkrebs!!!!

Ist wie bei Playstation und Xbox die Playstation war in den letzten Jahren immer weit vorne aber dieses Jahr macht Microsoft vieles besser Xbox one X ! Game Pass ! Selbst Konfigurierbare Controller! Play Anywhere! Unterstützung von Maus und Tastatur! etc…

Bis auf den ersten Satz stimme ich Deinen Aussagen voll zu. Leider gehört Google (neben Apple) zu den sich ausruhenden, innovationslosen Dinos. Selbst wenn der Nachtmodus technisch interessant ist, die besseren Kameralösungen (Kombi Hard- und Software) bauen mittlerweile andere und bessere Smartphones sowieso. Leider, muss ich sagen, denn wenn Google mal von ihrem hohen Ross der Single Lens absteigen könnten und auch preislich vernünftig agieren würden hätten sie eine Chance.

Das Pixel schießt eindeutig die besseren Bilder.

Ich finde est richtig lustig wie die Appel Fanboys hier irgendwelche Argumente finden müssen um ihr 1600 Euro IPhone zu rechtfertigen.

Leider ist es halt nunmal so das jede Firma bzw: Marken sich bei einer jahrelangen (Machtherschafft)

Zurücklehnt und keine Innovationen mehr bring zb die Notch die ist Katastrophal. Wer schaut sich bitte gerne Videos mit so was an? Augenkrebs!!!!

Ist wie bei Playstation und Xbox die Playstation war in den letzten Jahren immer weit vorne aber dieses Jahr macht Microsoft vieles besser Xbox one X ! Game Pass ! Selbst Konfigurierbare Controller! Play Anywhere! Unterstützung von Maus und Tastatur! etc…

Vorsicht, irgendwann ist Deine !-Taste kaputt.

Und Phone X steht nicht für Iphon X oder so etwas. Es Steht für auf gut Deutsch für ein X beliebiges Smartphone. Ihr Kartoffelköpfe

Schau doch bei dem Bild unten links in die Ecke. Also manchmal …

Marcels Interpretation könnte durchaus stimmen:

Auch wenn das dunkle Bild zufällig mit einem iPhone Xs aufgenommen wurde, steht das X generell für alle anderen außer Pixel 3. (Zumal es auch komisch wäre, ein aktuelles Pixel mit dem iPhone aus dem Vorjahr zu vergleichen.)

Und das stimmt auch nicht siehe Huawei Mate 20 Pro …

Mir schon klar, aber Werbung lebt ja oft gerade vom Weglassen unzuträglicher Fakten.

Na wer sich gern von Google anlügen lassen will.

Low light und Frontkamera waren bei Android schon immer sehr viel besser als bei Apple. Night light ist schon nicht übel aber galt auch nur ein Softwaretrick.